Esta é uma de quatro postagens resumindo centenas de páginas de relatórios técnicos focados inteiramente na previsão de um número: o ano no qual a IA transformadora será desenvolvida.74

Por “IA Transformadora”, quero dizer “IA poderosa o suficiente para nos levar a um futuro novo e qualitativamente diferente”. Eu me concentro especificamente no que estou chamando de PASTA: sistemas de IA que conseguem automatizar essencialmente todas as atividades humanas necessárias para acelerar o avanço científico e tecnológico.

Quanto mais cedo o PASTA for desenvolvido, mais cedo o mundo poderá mudar radicalmente, e parece que o mais importante para pensarmos hoje seria como fazer com que essa mudança seja bem ou malsucedida.

Em artigos futuros, apresentarei dois métodos para chegar ao “melhor palpite” sobre quando podemos esperar que a Inteligência Artificial transformadora seja desenvolvida. Mas primeiro, neste artigo, vou abordar a questão: quão bons esses métodos de previsão precisam ser para podermos levá-los a sério? Em outras palavras, qual é o “ônus da prova” da previsão de cronologias de Inteligência Artificial transformadora?

Quando alguém prevê o surgimento da Inteligência Artificial transformadora no século XXI – especialmente quando se está ciente de todas as consequências que isso traria – uma resposta intuitiva comum é algo do tipo: “Afirmar que a Inteligência Artificial transformadora surgirá neste século é algo realmente exagerado e audacioso. Portanto, é melhor que os seus argumentos sejam realmente bons.”

Acho que esta é uma primeira reação muito razoável às previsões sobre Inteligência Artificial transformadora (e corresponde à minha própria reação inicial). Mas tentei analisar o que pode estar motivando essa reação e como ela pode ser justificada, tendo feito isso, acabei não concordando com essa reação.

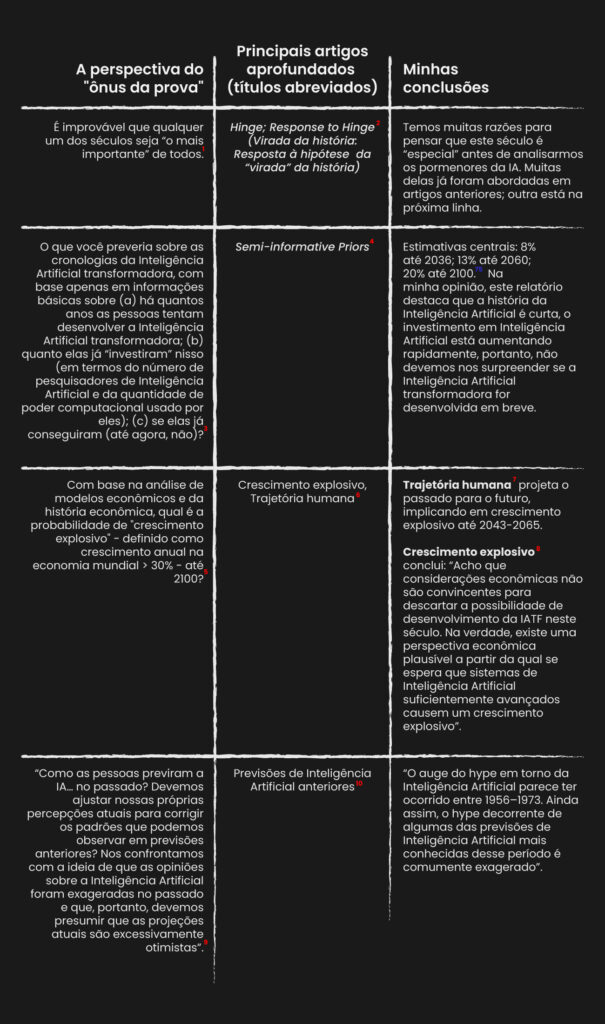

Para fins de transparência, observe que os relatórios das três últimas linhas são todos resultantes de análises realizadas pela Open Philanthropy.

- Acho que há vários motivos para pensar que o surgimento da Inteligência Artificial transformadora — ou algo igualmente importante — seja razoavelmente provável neste século, mesmo antes de termos analisado os pormenores das pesquisas sobre IA, o progresso que a Inteligência Artificial tem tido, etc.

- Contudo, também acredito que, no que concerne aos tipos de cronologias que abrangem várias décadas, devemos estar sempre abertos a mudanças grandiosas, radicais e até mesmo, revolucionárias. Nesse contexto, acredito que estimativas específicas e bem embasadas de quando a Inteligência Artificial transformadora será desenvolvida podem ser confiáveis, mesmo que elas envolvam muitas suposições e não sejam sólidas.

Esta postagem tenta explicar o que quero dizer.

Abaixo, eu: (a) serei um pouco mais específico sobre quais são as previsões de Inteligência Artificial transformadora que estou defendendo; em seguida, (b) discutirei como formalizar a reação do tipo “Isso é audacioso demais” a respeito de tais previsões; e, então, (c) analisarei cada um dos itens abaixo que descrevem uma maneira diferente de se formalizar essa reação.

Algumas probabilidades aproximadas

Aqui, tentarei defender algumas coisas sobre a Inteligência Artificial transformadora nas quais acredito:

- Acho que há mais de 10% de probabilidade de desenvolvermos algo parecido o suficiente com o PASTA para ser qualificado como “IA transformadora” dentro de 15 anos (até 2036); aproximadamente 50% disso acontecer dentro de 40 anos (até 2060); e aproximadamente 2/3 de chance que isso ocorra ainda neste século (até 2100).

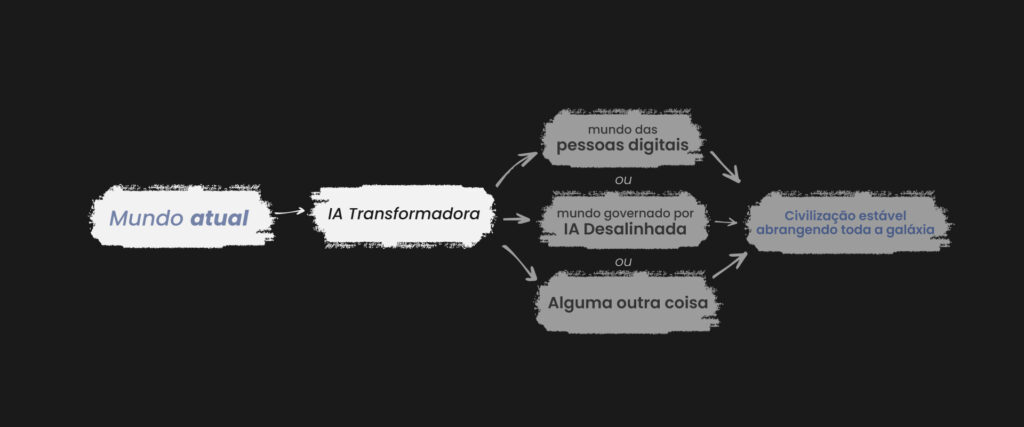

- Desde que o que foi dito acima de fato aconteça, acredito que há pelo menos 50% de chance de que logo depois disso estaremos vivendo em um mundo governado por pessoas digitais ou por Inteligência Artificial desalinhada, de forma que será justo dizer que: “transitamos para um estado onde os humanos, tais como os conhecemos, não são mais a força principal nos eventos mundiais.” (Isto corresponde ao primeiro argumento na minha definição de “século mais importante” no roteiro.)

- E, também, na condição de que o que foi dito acima se concretize, acredito que há pelo menos 50% de chance de que, qualquer que seja essa força principal nos eventos mundiais, ela conseguirá criar uma civilização estável em toda a galáxia por bilhões de anos. (Isto corresponde ao segundo argumento na minha definição de “século mais importante” no roteiro.)

Também coloquei um pouco mais de detalhes sobre o que quero dizer com o “século mais importante” aqui.

Formalizando a reação do tipo “Isso é audacioso demais”

Frequentemente, alguém defende uma posição na qual não consigo encontrar falhas de imediato, mas que instintivamente acho “audaciosa demais” para ser provável. Por exemplo, “Minha startup será o próximo Google” ou “As faculdades ficarão obsoletas em 10 anos” ou “Como presidente, eu unificaria ambos os lados do espectro político, em vez de ser partidário.”

Suponho que a reação do tipo “Isso é audacioso demais” a declarações como essas, geralmente pode ser formalizada da seguinte forma: “Quaisquer que sejam seus argumentos para X ser provável, existe alguma maneira óbvia de constatar as coisas (que pode ser muitas vezes simplificada demais, mas relevante) que faz X parecer muito improvável.”

Para os exemplos que acabei de dar:

- “Minha startup será o próximo Google.” Há inúmeras startups (milhões?), e a grande maioria delas acaba não sendo como o Google. (Mesmo quando seus fundadores pensam que sim!)

- “Faculdades ficarão obsoletas em 10 anos.” As faculdades foram criadas há centenas de anos e elas continuam sendo relevantes até hoje.

- “Como presidente, eu unificaria ambos os lados do espectro político, em vez de ser partidário.” Isso é algo que os candidatos a presidente dos EUA costumam dizer, mas aparentemente o partidarismo só tem aumentado nas últimas décadas.

Cada um desses casos estabelece uma espécie de ponto de partida (ou probabilidade a priori) e ônus da prova, e podemos então considerar mais evidências que superem esse ônus. Ou seja, podemos perguntar coisas como: o que torna esta startup diferente de tantas outras startups que pensam que podem ser o próximo Google? O que torna a próxima década diferente de todas as décadas anteriores, durante as quais as faculdades permaneceram importantes? O que esse candidato à presidência tem de diferente dos últimos candidatos?

Existem várias maneiras diferentes de pensar sobre o ônus da prova para minhas afirmações acima: várias maneiras de estabelecer uma probabilidade a priori (“ponto de partida”), que possa ser atualizada por evidências posteriores.

Muitas delas representam diferentes aspectos da intuição “Isso é audacioso demais”, gerando probabilidades a priori que (pelo menos inicialmente) fazem com que as probabilidades que dei pareçam muito altas.

Abaixo, eu analisarei algumas dessas “probabilidades a priori” e examinarei o que elas significam para o “ônus da prova” nos métodos de previsão que discutirei em postagens posteriores.

Diferentes perspectivas sobre o ônus da prova

Ceticismo sobre “o século mais importante”

Uma perspectiva sobre o ônus da prova funciona dessa forma:

- Holden afirma haver de 15 a 30% de probabilidade de que este seja “o século mais importante” em um sentido ou outro.76

- Todavia, já se passaram muitos séculos na história e a maioria deles não pode ser “o” mais importante. Especificamente:

- Os humanos existem de 50.000 a aproximadamente 5 milhões de anos, dependendo da sua definição de “humanos”.77 Isso pode ser de 500 a 50.000 séculos.

- Se presumirmos que nosso futuro será tão longo quanto nosso passado foi, ainda haverá de 1.000 a 100.000 séculos no total.

- Portanto, a probabilidade a priori (ponto de partida) para qual desses séculos é “o século mais importante” é de 1/100.000 a 1/1.000.

- Na verdade, é pior do que isso: Holden falou que a civilização durará por bilhões de anos. Isso seria dezenas de milhões de séculos, então a probabilidade a priori de um dado século ser “o século mais importante” é menor que 1/10.000.000

- (Are We Living at the Hinge of History? (Estamos vivendo na virada da história?) argumenta nesse sentido em termos gerais, embora com algumas diferenças.78)

- Este argumento parece estar bem perto de representar minha maior fonte de hesitação no passado sobre a hipótese do “século mais importante”. No entanto, acredito que há muitos indicadores de que este não é um século mediano, mesmo antes de considerarmos argumentos específicos sobre IA.

- Um aspecto fundamental foi enfatizado na minha postagem anterior, Todas as visões possíveis sobre o futuro da humanidade são audaciosas. Se você acha que os humanos (ou nossos descendentes) têm bilhões de anos pela frente, deve pensar que estamos entre os primeiros humanos, o que torna muito mais plausível que a nossa época esteja entre as mais importantes. (Este argumento também foi enfatizado em Reflexões sobre se estamos vivendo no momento mais influente da história, assim como comentários sobre uma versão mais antiga de Are We Living at the Hinge of History? (Estamos vivendo na virada da história?).

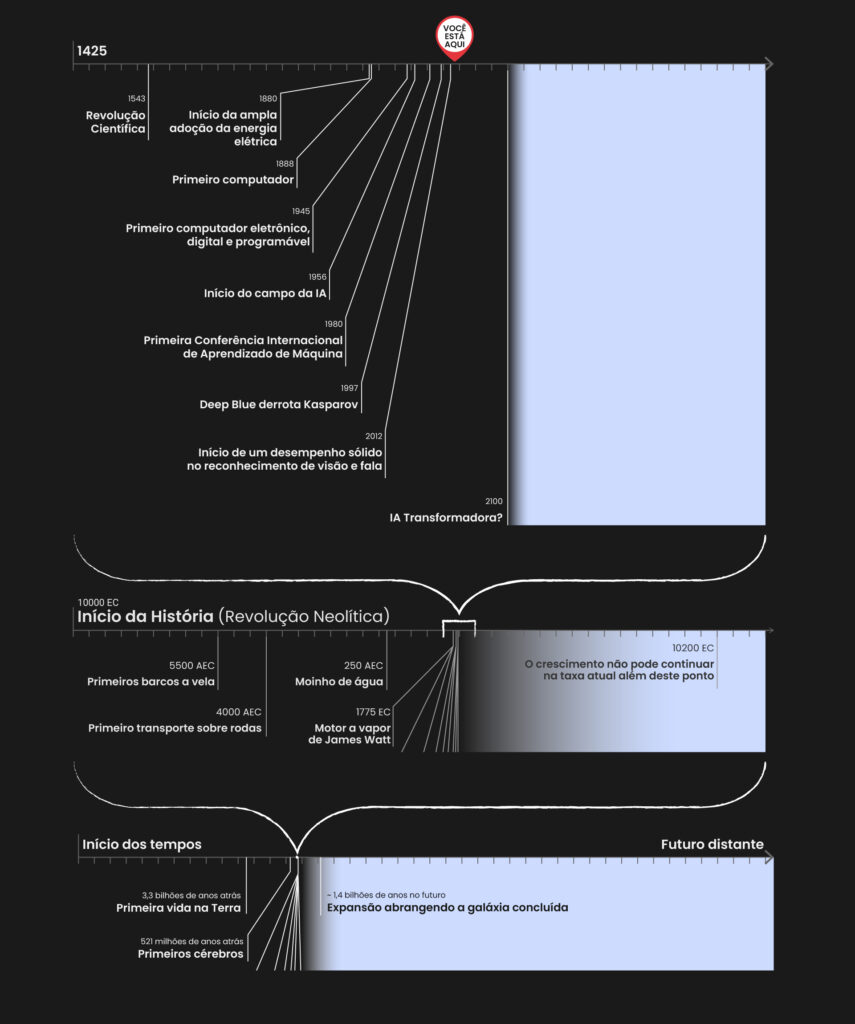

- Além disso, embora a humanidade exista há alguns milhões de anos, na maior parte desse tempo tivemos populações extremamente baixas e muito pouco em termos de aumento de progresso tecnológico aconteceu. A civilização humana começou há cerca de 10.000 anos, e desde então já chegamos ao ponto de construir computadores digitais programáveis e explorar nosso sistema solar.

- Com esses argumentos em mente, parece razoável pensar que eventualmente estabeleceremos uma civilização estável em toda a galáxia, em algum momento nos próximos 100.000 anos (1000 séculos). Ou pensar que há 10% de probabilidade de fazermos isso em algum momento nos próximos 10.000 anos (100 séculos). De qualquer forma, isso implica que um determinado século tem uma chance de aproximadamente 1/1.000 de ser o século mais importante para o estabelecimento dessa civilização — muito mais do que as probabilidades mencionadas anteriormente nesta seção. Isto ainda é aproximadamente 100 vezes menor do que números que dei acima, então o ônus da prova ainda existe.

- Existem outras razões para pensar que este século em específico é incomum. Por exemplo, veja Isto não pode continuar:

- A economia mundial total cresceu mais nos últimos 2 séculos do que em todos os outros séculos juntos.

- A atual taxa de crescimento econômico não pode ser sustentada por mais outros 80 séculos ou mais. (E como discutido abaixo, se a tendência de aceleração anterior fosse retomada, isso implicaria um crescimento explosivo e atingiria os limites do que é possível neste século.)

- É plausível que a ciência tenha avançado mais nos últimos 5 séculos do que todos os outros séculos da história somados.

Um argumento final que torna a nossa época especial: enquanto ainda vivemos no início do desenvolvimento das pesquisas de IA, já estamos discutindo sobre quando esperamos o surgimento da Inteligência Artificial transformadora. Em bem menos de 1 século, passamos do primeiro computador eletrônico programável de uso geral para modelos de Inteligência Artificial que podem competir com humanos em reconhecimento de fala,79 classificação de imagens e muito mais.

Mais sobre as implicações disso na próxima seção.

Obrigado a María Gutiérrez Rojas por este gráfico. A cronologia superior ilustra quão recentes são as principais conquistas da computação e da IA. Abaixo estão (cortadas) outras cronologias mostrando o quão importantes este intervalo de algumas centenas de anos (mais em Isto não pode continuar), e esta era (mais em Todas as visões possíveis sobre o futuro da humanidade são audaciosas), parecem ser.

Report on Semi-informative Priors (Relatório sobre prioris semi- informativas) (referido neste artigo como Semi-informative Priors) é uma tentativa extensa de prever cronologias da Inteligência Artificial transformadora, usando o mínimo possível de informações sobre as especificidades da IA.

Portanto, é uma maneira de fornecer uma perspectiva sobre o ônus da prova — ou seja, estabelecer um conjunto de probabilidades a priori (pontos de partida) de quando a Inteligência Artificial transformadora será desenvolvida, antes de examinarmos as evidências detalhadas.

A informação central que ela utiliza é: quanto esforço já foi feito para desenvolver a Inteligência Artificial até agora. A ideia básica é a seguinte:

- Se estivéssemos tentando e falhando no desenvolvimento da Inteligência Artificial transformadora por milhares de anos, as chances de sucesso nas próximas décadas seriam baixas.

- Entretanto se estivermos tentando desenvolver sistemas de Inteligência Artificial há apenas algumas décadas, isso significa que as próximas décadas poderão conter uma grande fração de todo o esforço que já foi feito. Assim, as chances de desenvolver a Inteligência Artificial transformadora nesse período não são tão baixas.

- Uma maneira de pensar sobre isso é que, antes de analisarmos os detalhes do progresso da IA, devemos ser um pouco “agnósticos” sobre se desenvolver uma Inteligência Artificial transformadora é relativamente “fácil” (pode ser feito em algumas décadas) ou “difícil” (levaria milhares de anos). Como as coisas continuam no início, a possibilidade de que isso seja “fácil” continua em aberto.

Um pouco mais sobre a abordagem e as conclusões do relatório:

Perspectiva de análise. O relatório levanta a seguinte questão (parafraseada): “Suponha que você tenha se isolado no dia em que as pessoas começaram a investir na construção de sistemas de IA. E agora suponha que você tenha recebido atualizações anuais sobre (a) há quantos anos as pessoas tentam construir uma Inteligência Artificial transformadora; (b) o quanto elas já ‘investiram’ nesse processo (em termos de tempo e dinheiro); (c) se elas já tiveram sucesso (até agora, não tiveram). O que você pode prever sobre cronologias da Inteligência Artificial transformadora, tendo apenas essas informações como base, em 2021?”

Seus métodos são inspirados no Problema do nascer do sol: “Imagine que você desconhece tudo sobre o universo, exceto que o sol nasce diariamente. Se o sol nasceu em todos os N dias passados, qual a probabilidade de nascer amanhã? Mesmo sem conhecimento astronômico, é possível estimar essa probabilidade. Existem métodos matemáticos simples que utilizam a frequência de eventos passados para prever a probabilidade de sua ocorrência futura… A “Priori semi-informativa” estende esses métodos matemáticos para adaptá-los às cronologias de Inteligência Artificial transformadora. (Neste caso, “o nascer do sol” seria “O fracasso em desenvolver Inteligência Artificial transformadora, como fizemos no passado”.)

Conclusões. Não entrarei muito nos detalhes de como a análise funciona (veja a postagem no blog resumindo o relatório para mais detalhes), mas as conclusões do relatório incluem o seguinte:

- O relatório calcula que a probabilidade da inteligência artificial geral (IAG, que incluiria o PASTA) ser desenvolvida até 2036 é de 1 a 18%, com uma melhor estimativa de 8%.

- A probabilidade de isso ocorrer até 2060 é de cerca de 3 a 25% (melhor estimativa de aproximadamente 13%), e a probabilidade da IAG ser desenvolvida até 2100 é de cerca de 5 a 35%, melhor estimativa de 20%.

Elas são menores do que as probabilidades que sugiro acima, mas não muito menores. Isso significa não haver um enorme ônus da prova ao se considerar evidências adicionais sobre as especificidades do investimento e progresso da IA.

Observações sobre a data de início do processo. Algo interessante aqui é que o relatório é menos sensível do que se poderia imaginar a respeito de como definir a “data de início” do processo de tentativas de desenvolver a IAG. (Veja esta seção do relatório completo.) Ou seja:

- Por padrão, a “Priori semi-informativa” modela a situação como se a humanidade tivesse começado a “tentar” construir a IAG em 1956.80 Isso implica que esse trabalho tem apenas cerca de 65 anos, portanto, as próximas décadas representarão uma grande fração desse esforço.

- O relatório também analisa outros parâmetros de “esforço para construir a IAG” — notadamente, tempo de pesquisa e “computação” (poder de processamento). Mesmo que você queira dizer que estamos implicitamente tentando construir a IAG desde o início da civilização humana, há cerca de 10.000 anos, as próximas décadas conterão uma grande parte do esforço de pesquisa e computação investidos nessa tentativa.

O argumento principal nesta seção

- Ocasionalmente, ouço alguém dizer algo como “Estamos tentando construir uma Inteligência Artificial transformadora há décadas e ainda não conseguimos — por que você acha que no futuro isso será diferente?” No mínimo, este relatório reforça o que vejo como a posição de senso comum de que algumas décadas de “nenhuma Inteligência Artificial transformadora ainda, apesar dos esforços que fizemos para desenvolvê-la” não ajuda muito a argumentar contra a possibilidade de que a Inteligência Artificial transformadora será desenvolvida nas próximas décadas.

- Na verdade, no final das contas, estamos muito próximos de quando as tentativas de desenvolvimento da Inteligência Artificial se iniciaram — o que é outra forma do nosso século ser “especial”. Tanto que não devemos nos surpreender se este século acabar sendo um dos mais importantes para o desenvolvimento da IA.

Crescimento econômico

Outra perspectiva sobre o ônus da prova neste sentido é:

Se o PASTA fosse desenvolvido a qualquer momento, e se ele desencadeasse as consequências descritas nesta série de postagens, isso seria uma grande mudança no mundo — e o mundo simplesmente não muda tão rápido.

Para quantificar isso: a economia mundial cresceu alguns por cento ao ano nos últimos 200 anos, e o PASTA implicaria numa taxa de crescimento muito mais rápida, possivelmente 100% ao ano ou acima disso.

Se estivéssemos caminhando para um mundo de crescimento econômico explosivo, o crescimento já deveria estar acelerando hoje. E ele não está acelerando – está se estagnando, pelo menos nas economias mais desenvolvidas. Se a Inteligência Artificial realmente fosse revolucionar tudo, o mínimo que ela poderia estar fazendo atualmente é criando valor suficiente — novos produtos, transações e empresas suficientes — para acelerar o crescimento econômico geral dos EUA.

A Inteligência Artificial pode levar ao desenvolvimento de novas tecnologias interessantes, mas não há sinal algum do surgimento de algo tão importante quanto o PASTA seria. Partindo do ponto onde estamos e seguindo para onde o PASTA nos levaria está o tipo de mudança repentina que não aconteceu no passado e é improvável que ela aconteça no futuro.

(Se você não estiver familiarizado com o que quero dizer com crescimento econômico, pode ser que você queira ler a minha breve explicação antes de continuar.)

Acho que essa é uma perspectiva razoável e ela me deixa especialmente cético em relação a previsões muito iminentes para Inteligência Artificial transformadora (até 2036 e antes disso).

Minha principal resposta é que a perspectiva de um crescimento constante – “a economia mundial crescendo a uma taxa de alguns por cento ao ano” – fica muito mais complicada quando recuamos e analisamos toda a história econômica, em vez de considerar apenas os últimos séculos. A partir dessa perspectiva, o crescimento econômico tem em sua maior parte acelerado,81 e projetar essa aceleração para o futuro poderia acarretar um crescimento econômico muito rápido nas próximas décadas.

Escrevi sobre isso anteriormente em O duplicador e Isto não pode continuar; aqui recapitularei brevemente os principais relatórios que citei lá.

Could Advanced AI Drive Explosive Economic Growth? (A Inteligência Artificial avançada poderia impulsionar o crescimento econômico explosivo?) faz explicitamente a pergunta: “Qual é a probabilidade de “crescimento explosivo” – definido como crescimento anual na economia mundial > 30% – até 2100?” O relatório considera argumentos de ambos os lados, incluindo (a) a visão de longo prazo da história que mostra crescimento acelerado; (b) que o crescimento tem sido notavelmente estável nos últimos 200 anos aproximadamente, sugerindo que algo pode ter mudado.

E conclui: “as possibilidades de crescimento de longo prazo estão indefinidas. Tanto o crescimento explosivo quanto a estagnação são plausíveis”.

Modeling the Human Trajectory (Modelando a trajetória humana) indaga que futuro podemos esperar se extrapolarmos as tendências existentes ao longo da história econômica. A resposta é um crescimento explosivo até 2043–2065 – não muito longe do que minhas probabilidades acima sugerem. Isso pressupõe que a falta de aceleração econômica nos últimos 200 anos, aproximadamente pode ser uma “anomalia” — que poderá ser resolvida em breve pelo desenvolvimento de uma tecnologia capaz de restaurar a retroalimentação (tema discutido em O Duplicador) que pode fazer com que a aceleração continue.

Para deixar claro, também há boas razões para não dar muita importância para isso como sendo uma projeção,82 e mais como sendo uma perspectiva sobre o “ônus da prova” do que como uma previsão principal de quando o PASTA será desenvolvido. Há um debate em aberto sobre se os dados econômicos anteriores realmente mostram uma aceleração sustentada, em oposição a uma série de períodos muito diferentes com taxas de crescimento crescentes. Discuto como o debate poderia mudar minhas conclusões aqui.

Histórico do “hype em torno da IA”

Outra perspectiva sobre o ônus da prova: às vezes, ouço comentários do tipo “Houve um hype exagerado em torno da Inteligência Artificial muitas vezes no passado, e a Inteligência Artificial transformadora83 de acordo com aficionados por tecnologia parece sempre estar muito próxima de se tornar realidade”. As suas estimativas são apenas as mais recentes nessa longa tradição. Como as estimativas anteriores estavam erradas, as suas provavelmente também estão.

No entanto, não acredito que o histórico do “hype em torno da IA” confirme esse tipo de afirmação.

What should we learn from past AI forecasts? (O que devemos aprender com previsões anteriores de IA?) revisou históricos da Inteligência Artificial para tentar entender qual foi o padrão histórico real do “hype em torno da IA”.

Seu resumo dá as seguintes impressões (observe que “HLMI” ou “inteligência artificial de nível humano” é uma ideia bastante semelhante ao PASTA):

- O auge do hype em torno da Inteligência Artificial parece ter ocorrido entre 1956-1973. Ainda assim, o hype decorrente de algumas das previsões de Inteligência Artificial mais conhecidas desse período costuma ser exagerado.

- Após 1973, aproximadamente, poucos especialistas pareciam discutir a HLMI (ou algo semelhante) como uma possibilidade de médio prazo, em parte porque muitos especialistas aprenderam com o fracasso do otimismo excessivo anterior da área.

- O segundo grande período de hype em torno da IA, no início dos anos 1980, parece ter sido mais sobre a possibilidade de “sistemas especialistas” comercialmente úteis e de propósito restrito, não sobre HLMI (ou algo semelhante)…

- Não sei se eu teria sido persuadido pelas críticas contemporâneas ao otimismo inicial a respeito da Inteligência Artificial ou se teria considerado fazer o tipo certo de perguntas céticas na época. A crítica mais substancial durante os primeiros anos foi de Hubert Dreyfus, e meu palpite é que eu a teria achado persuasiva na época, mas não posso ter certeza disso.

Em suma, não é particularmente justo dizer que houve muitas ondas de previsões separadas e excessivamente agressivas sobre Inteligência Artificial transformadora. As expectativas eram provavelmente muito altas no período de 1956 – 1973, mas não acredito que haja muita razão aqui para impor um enorme “ônus de prova” sobre estimativas atuais bem embasadas.

Outras perspectivas sobre o ônus da prova

Aqui estão algumas outras formas possíveis de representar a reação do tipo “Isso é audacioso demais”:

Alegações do tipo “Minha causa é muito importante”. Muitas pessoas – em todo o mundo atual e ao longo da história – afirmam ou afirmaram que qualquer problema no qual elas estejam trabalhando para resolver é extremamente importante, muitas vezes alegando que possa haver riscos globais ou até mesmo para toda a galáxia. A maioria dessas pessoas estão certamente erradas.

Aqui, acredito que é fundamental indagar se essa afirmação é embasada em argumentos melhores e/ou pessoas mais confiáveis do que são as outras afirmações do tipo “Minha causa é muito importante”. Se você se aprofundou na leitura sobre a hipótese do “século mais importante”, acredito que já está se colocando em uma boa posição para responder a essa pergunta você mesmo.

A opinião de especialistas será amplamente abordada em postagens futuras. Por enquanto, meu posicionamento principal é que minhas afirmações nem contradizem um consenso específico de especialistas, nem são apoiadas por um. Elas são, ao contrário, afirmações sobre tópicos que simplesmente não têm “uma área do conhecimento” com especialistas dedicados a estudá-los. Algumas pessoas podem optar por ignorar quaisquer afirmações que não sejam ativamente corroboradas por um consenso robusto de especialistas; mas, considerando o que está em jogo, não acredito que seja isso que deveríamos fazer neste caso.

(Dito isso, o melhor estudo disponível feito por pesquisadores de Inteligência Artificial chegou a conclusões que parecem bastante consistentes com as minhas, como discutirei na próxima postagem.)

Reações não representadas do tipo “Isso é audacioso demais”. Tenho certeza de que este artigo não apresentou todas as perspectivas possíveis que poderiam estar subjacentes a uma reação do tipo “Isso é audacioso demais”. (Mas não foi por falta de tentativa!) Algumas pessoas simplesmente terão intuições irredutíveis de que as alegações desta série são audaciosas demais para serem levadas a sério.

Uma visão geral dessas perspectivas. Algo que me incomoda sobre a maioria das perspectivas abordadas nesta seção: é que elas parecem genéricas demais. Se você simplesmente se recusar (na ausência de evidências esmagadoras) a acreditar em qualquer afirmação que se encaixe em um padrão do tipo “minha causa é muito importante”; ou que ainda não seja corroborada por um consenso robusto de especialistas; ou que simplesmente soe audaciosa demais, isso parece um padrão de raciocínio perigoso. Presumivelmente, algumas pessoas, às vezes, viverão no século mais importante; devemos suspeitar de quaisquer padrões de raciocínio que levem84 essas pessoas a concluírem que não vivem nele.

Notas

74Claro, a resposta poderia ser “Daqui a zilhões de anos” ou “Nunca”.

75Tecnicamente, essas probabilidades são para “inteligência artificial geral”, não para Inteligência Artificial transformadora. As probabilidades do surgimento da Inteligência Artificial transformadora podem ser maiores se for possível ter uma Inteligência Artificial transformadora sem inteligência artificial geral, por meio de algo como o PASTA, por exemplo.

76Isso corresponde aos dois marcadores do segundo tópico desta seção.

77Wikipedia: “Medições genéticas indicam que a linhagem dos macacos que levaria ao Homo sapiens divergiu da linhagem que levaria aos chimpanzés e bonobos, os parentes vivos mais próximos dos humanos modernos, cerca de 4,6 a 6,2 milhões de anos atrás. [23] Humanos anatomicamente modernos surgiram na África há cerca de 300.000 anos, [24] e atingiram a modernidade comportamental há cerca de 50.000 anos. [25]”

78Por exemplo, enfatiza a probabilidade de se estar entre as “pessoas” mais importantes em vez de “séculos” mais importantes.

79Eu não tenho uma fonte única que reúna tudo isso, embora você possa ver este artigo. Minha impressão informal ao conversar com pessoas no campo é que o reconhecimento de fala da Inteligência Artificial está pelo menos bem próximo do nível humano, se não, melhor.

80“Considera-se amplamente que o campo de estudos da Inteligência Artificial começou em Dartmouth em 1956”

81Modeling the Human Trajectory (Modelando a trajetória humana) enfatiza que o modelo que gera esses números “não é flexível o suficiente para acomodar totalmente eventos tão grandes e repentinos quanto a revolução industrial”. O autor acrescenta: “Especialmente porque corresponde imperfeitamente ao passado, sua projeção para o futuro deve ser interpretada livremente, como meramente acrescentando plausibilidade a uma ascensão no próximo século. Davidson (2021) Could Advanced AI Drive Explosive Economic Growth” (Poderia a Inteligência Artificial avançada impulsionar crescimento econômico explosivo?) aponta uma maneira importante pela qual as projeções podem continuar erradas por muitas décadas: embora a dinâmica do modelo seja dominada por uma aceleração econômica em espiral, as pessoas ainda são um insumo importante à produção e, ao contrário, o aumento da riqueza levou as pessoas a terem menos e não mais filhos. Nas próximas décadas, isso poderia prejudicar a aceleração prevista, de forma que não poderemos ou não substituiremos trabalhadores por robôs.”

82Esses tipos de comentários geralmente se referem a IGA e não à Inteligência Artificial transformadora, mas os conceitos são semelhantes o suficiente para que eu os use de forma intercambiável aqui.

83(Na ausência de evidências esmagadoras, as quais não acredito que devemos presumir que estarão presentes sempre que precisarmos delas).

84Claro, a resposta poderia ser “Daqui a um zilhão de anos” ou “Nunca.”