Esta é uma de quatro postagens resumindo centenas de páginas de relatórios técnicos focados quase inteiramente na previsão de um número: o ano no qual a Inteligência Artificial transformadora será desenvolvida.96

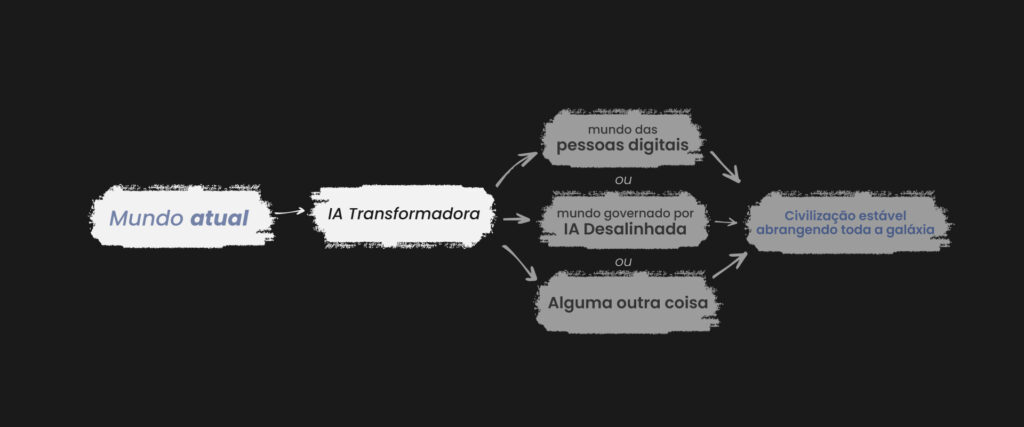

Por “IA Transformadora”, quero dizer “IA poderosa o suficiente para nos levar a um futuro novo e qualitativamente diferente”. Eu me concentro especificamente no que estou chamando de PASTA: sistemas de Inteligência Artificial que conseguem automatizar essencialmente todas as atividades humanas necessárias para acelerar o avanço científico e tecnológico.

Quanto mais cedo o PASTA for desenvolvido, mais cedo o mundo poderá mudar radicalmente, e parece que o mais importante para pensarmos hoje seria como fazer com que essa mudança seja bem ou malsucedida.

Esta postagem é um resumo para leigos do artigo Forecasting Transformative AI with Biological Anchors (Prevendo a Inteligência Artificial Transformadora com âncoras biológicas) de Ajeya Cotra, e seus prós e contras.97 É a previsão que considero mais esclarecedora para Inteligência Artificial transformadora, com algumas ressalvas:

- Essa abordagem é relativamente complexa e requer inúmeras suposições e estimativas incertas. Essas características tornam-na relativamente difícil de explicar e, também, depõem contra a confiabilidade do método.

- Portanto, atualmente, não acredito que esse método seja tão confiável quanto os exemplos que dei anteriormente para prever um futuro qualitativamente diferente. Ele não é tão simples ou objetivo como alguns desses exemplos, tais como os modelos para prever a disseminação da COVID-19. E embora a modelagem climática também seja muito complexa, ela foi desenvolvida por muitos especialistas ao longo de décadas, enquanto a metodologia das Bio-âncoras não tem um histórico longo.

No entanto, acho que este é, atualmente, o melhor método disponível para dar um “palpite” no que se refere às cronologias/linhas do tempo da Inteligência Artificial transformadora. E como discutido na seção final, pode-se deixar de lado muitos dos detalhes para constatar que este século, provavelmente, será testemunha de algumas das conquistas mais “extremas” mencionadas pelo relatório, que sugere fortemente a viabilidade da Inteligência Artificial transformadora.

(Observação: também escrevi uma postagem posterior sobre essa teoria para leitores céticos. Veja “Âncoras biológicas” é sobre delimitar e, não apontar, cronologias da IA.)

A ideia básica é:

- Os modelos modernos de Inteligência Artificial podem “aprender” a realizar tarefas por meio de um processo (financeiramente caro) conhecido como “treinamento”. O treinamento pode ser descrito como uma quantidade enorme de ações de tentativa e erro. Por exemplo, os modelos de Inteligência Artificial de reconhecimento de voz recebem um arquivo de áudio de alguém falando, dão um palpite sobre o que a pessoa está dizendo e, então, recebem a resposta correta. Ao fazer isso milhões de vezes, eles “aprendem” a traduzir de forma confiável a fala em texto. Mais: Treinamento

- Quanto maior for um modelo de Inteligência Artificial e mais complexa for a tarefa, mais caro será o processo de treinamento. Alguns modelos de Inteligência Artificial são maiores que outros; até o momento, nenhum deles chega nem perto de ser “tão grande quanto o cérebro humano” (abaixo explicarei o que isso quer dizer). Mais: Tamanho do modelo e tipo de tarefa

- O método das âncoras biológicas questiona: “Com base nos padrões usuais de custo de treinamento, quanto custaria treinar um modelo de Inteligência Artificial tão grande quanto um cérebro humano para executar as tarefas mais difíceis que os humanos conseguem fazer? E, quando isso será barato o suficiente para que alguém faça esse treinamento?” (Mais:) Estimando os custos

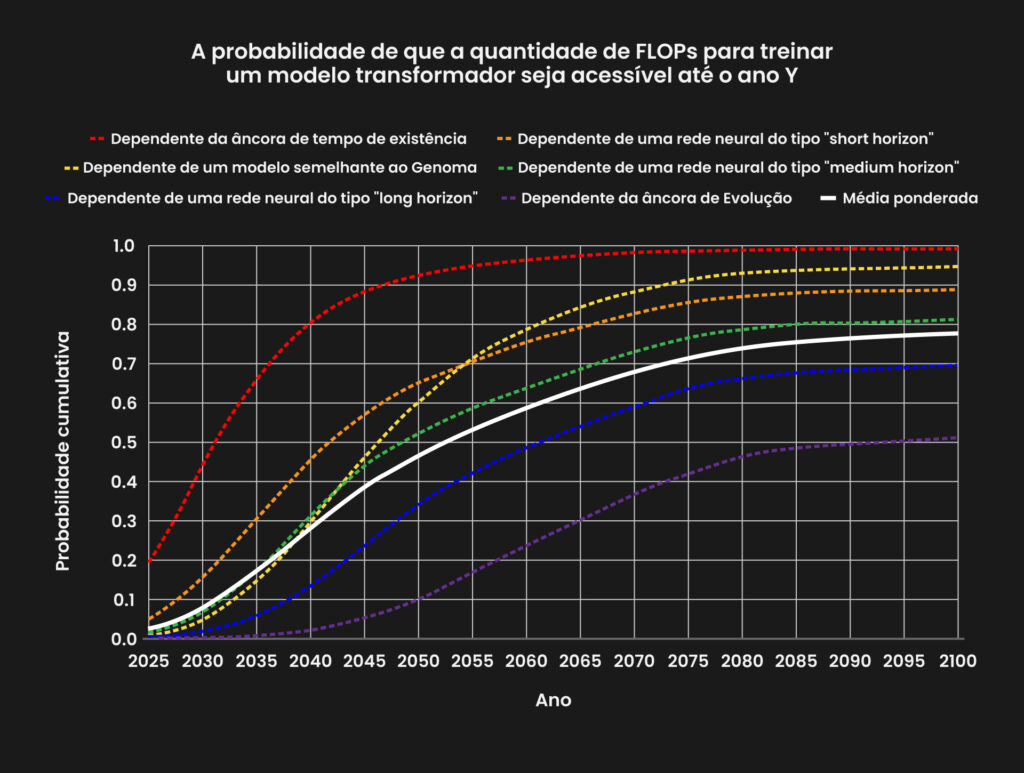

O método das âncoras biológicas modela muitas maneiras de se abordar essa questão, gerando uma ampla gama de estimativas, de “agressivas” (desenvolvimento da Inteligência Artificial transformadora mais cedo) a “conservadoras” (desenvolvimento mais tarde). Mas, a partir de praticamente todas essas perspectivas, ela prevê, com alta probabilidade, o desenvolvimento da Inteligência Artificial transformadora ainda neste século.

Este gráfico é do relatório. O eixo Y representa, aproximadamente, a probabilidade da Inteligência Artificial transformadora ser desenvolvida no ano em questão, embora haja algumas nuances adicionais no relatório. Não explicarei o que significa cada um dos diferentes modelos “Dependente de”; basta saber que cada um deles representa uma perspectiva diferente na previsão da Inteligência Artificial transformadora.

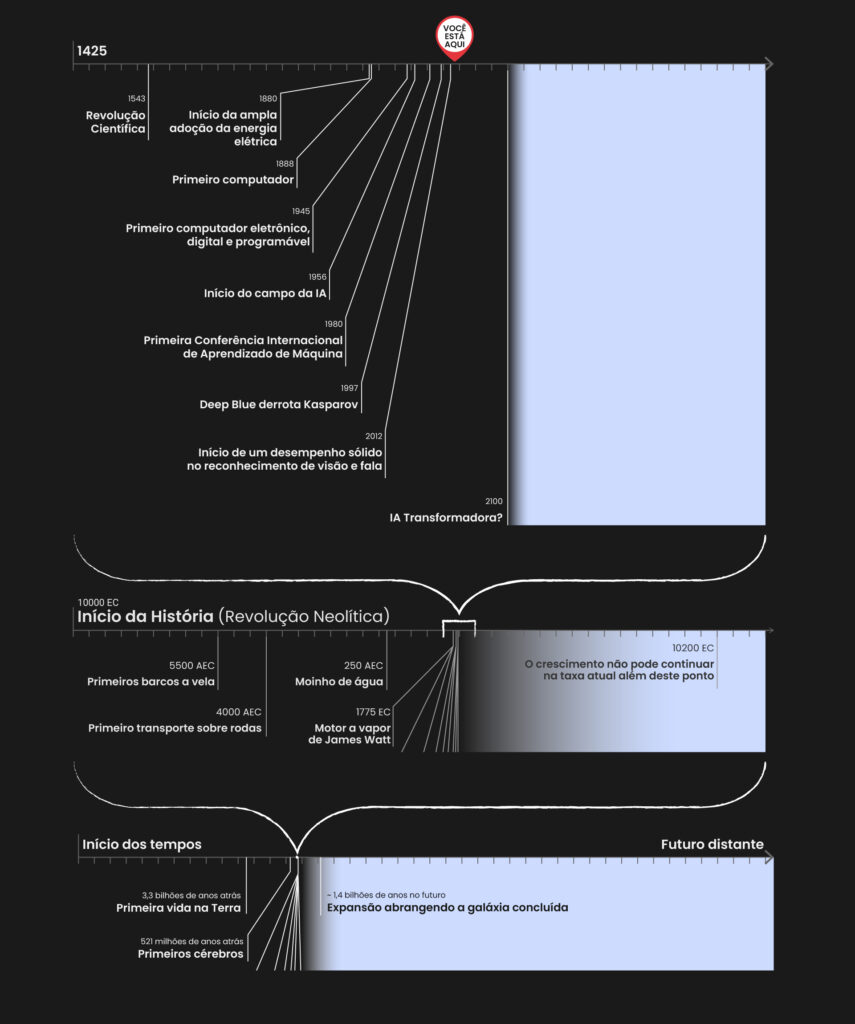

Obrigado a María Gutiérrez Rojas por este gráfico. A cronologia superior apresenta conquistas importantes para a computação de IA, no passado e para o futuro (as conquistas futuras são projetadas pelo Bio-âncoras). Abaixo estão (cortadas) outras cronologias mostrando o quão importantes este intervalo de algumas centenas de anos (mais em Isto não pode continuar), e esta era (mais em Todas as visões possíveis sobre o futuro da humanidade são audaciosas), parecem ser.

Agora me aprofundarei sobre cada um deles um pouco mais. Esta é a parte mais densa desta série, e algumas pessoas podem preferir apenas ler o resumo acima e pular para a próxima postagem.

Observe que o método das Bio-âncoras usa várias abordagens diferentes (que ele chama de “âncoras”) para estimar cronologias da Inteligência Artificial transformadora e as combina em uma só visão agregada. Neste resumo, estou mais focado em um conjunto específico delas – chamado de “âncoras da rede neural” – que impulsiona a maioria das cronologias agregadas do relatório. Parte do que digo se aplica a todas as âncoras, mas parte se aplica apenas às “âncoras da rede neural”.

Treinamento

Como discutido anteriormente, existem, essencialmente, duas maneiras de “ensinar” um computador a realizar uma tarefa:

- “Programar” o computador com instruções passo a passo extremamente específicas para concluir a tarefa. Quando isso é possível, o computador executa geralmente as instruções de forma muito rápida, confiável e barata. Por exemplo, você pode programar um computador para examinar cada registro em um banco de dados e imprimir os que correspondem aos termos de pesquisa de um usuário — você o “instruiria” exatamente como fazer isso e ele conseguiria realizar a tarefa muito bem.

- “Treinar” uma Inteligência Artificial para realizar a tarefa puramente por tentativa e erro. Hoje, a maneira mais comum de fazer isso é usando uma “rede neural”, que seria como um “cérebro digital” que está em um estado inicial vazio (ou aleatório): que ainda não foi programado para realizar tarefas específicas. Por exemplo, digamos que queremos que uma Inteligência Artificial reconheça fotos de cães e de gatos. É difícil dar instruções passo a passo totalmente específicas para isso; em vez disso, podemos alimentar uma rede neural com um milhão de imagens de exemplo (cada uma rotulada como “cachorro” ou “gato”). Cada vez que a Inteligência Artificial processa um exemplo, ela se ajusta internamente para aumentar a probabilidade de acertar em casos semelhantes no futuro. Após exemplos suficientes, ela estará configurada corretamente para reconhecer cães de gatos.

(Talvez pudéssemos subir o nível e treinar modelos para aprender com o próprio treinamento da maneira mais eficiente possível. Isso é chamado de meta-aprendizagem, mas pelo que sei esse método ainda não alcançou bons resultados.) O treinamento é uma espécie de alternativa mais cara e de força bruta do que a “programação”. A vantagem é que não precisamos fornecer instruções específicas, podemos apenas alimentar a Inteligência Artificial com muitos exemplos de como realizar uma tarefa corretamente, e ela aprenderá a realizá-la sozinha.

- A desvantagem é que precisamos de muitos exemplos, requerendo muito poder de processamento, com alto custo.

Quanto? Isso depende do tamanho do modelo (rede neural) e da natureza da própria tarefa. Para algumas tarefas que as IAs já aprenderam, até 2021, o treinamento de um único modelo pode custar milhões de dólares. Para tarefas mais complexas (como “desenvolver pesquisa científica inovadora”) e modelos maiores (do tamanho do cérebro humano), treinar um modelo pode custar muito mais do que isso.

O método das Bio-âncoras está interessado na questão: “Quando será econômico treinar um modelo para realizar as tarefas mais difíceis que os humanos conseguem realizar, usando uma abordagem relativamente rudimentar baseada em tentativa e erro?”

Essas tarefas podem incluir as tarefas necessárias para o PASTA, tais como:

- Aprender sobre ciência com professores, livros didáticos e trabalhos de casa de maneira mais eficaz que os humanos.

- Ultrapassar a fronteira da ciência fazendo perguntas, análises e escrevendo artigos de maneira mais eficaz que os humanos.

A próxima seção discutirá como o método das Bio-âncoras aprimora a ideia das “tarefas mais difíceis que os humanos conseguem realizar” (quais tarefas exigiriam um modelo do “tamanho do cérebro humano”).

Tamanho do modelo e tipo de tarefa

A hipótese do método das Bio-âncoras é que podemos estimar “o quanto custa treinar um modelo” com base em dois parâmetros básicos: o tamanho do modelo e o tipo de tarefa.

Tamanho do modelo. Conforme mencionado acima, uma rede neural seria como um “cérebro digital” que está em um estado inicial vazio ou aleatório. Em geral, um “cérebro digital” maior — com mais versões-digitais-de-neurônios e versões-digitais-de-sinapses98 – aprenderia tarefas mais complexas. Um “cérebro digital” maior também requer mais cálculos — e, consequentemente, seria mais caro — cada vez que ele for usado (por exemplo, a cada exemplo fornecido durante o treinamento).

Com base na análise descrita em How Much Computational Power Does It Take to Match the Human Brain? (Quanto poder computacional é necessário para igualar o cérebro humano?) de Joe Carlsmith (ao qual me refiro neste artigo como “Computação cerebral”), o método das Bio-âncoras estima comparações entre o tamanho de cérebros digitais (modelos de IA) e cérebros de animais (cérebros de abelhas, cérebros de camundongos, cérebros humanos).

Essas estimativas implicam que os sistemas de Inteligência Artificial atuais são, às vezes, tão grandes quanto os cérebros de insetos, mas nunca tão grandes quanto os cérebros de camundongos — até o momento em que isto foi escrito, o maior modelo de linguagem conhecido foi o primeiro a chegar razoavelmente perto desse tamanho.99 E ainda não tem nem 1% do tamanho do cérebro humano.100

Quanto maior for o modelo, mais poder de processamento será necessário para treiná-lo. O método das Bio-âncoras presume que um modelo de Inteligência Artificial transformadora precisaria ter cerca de 10 vezes o tamanho de um cérebro humano, muito maior do que qualquer modelo atual de IA. (O tamanho de 10 vezes maior foi escolhido para deixar algum espaço para a ideia de que “cérebros digitais” podem ser menos eficientes que os cérebros humanos; veja esta seção do relatório.) Esta é uma das razões pelas quais o treinamento seria muito caro.

Mas pode acontecer de um modelo de Inteligência Artificial menor ainda aprender os tipos de tarefas mencionadas acima. Ou pode ser que o tamanho do modelo necessário seja maior do que as estimativas geradas pelo método das Bio-âncoras, talvez porque ele tenha subestimado o “tamanho” efetivo do cérebro humano, ou porque o cérebro humano é melhor projetado do que os “cérebros digitais” para além do que o método supõe.

Tipo de tarefa. Para aprender uma tarefa, um modelo de Inteligência Artificial precisa efetivamente “tentar” realizar a tarefa (ou “assistir” à tarefa sendo realizada) inúmeras vezes, aprendendo por tentativa e erro. Quanto mais caro (em poder de processamento e, portanto, dinheiro) for tentar realizar a tarefa (ou assistir à tarefa sendo realizada), mais caro será aprendê-la.

É difícil quantificar o custo de se tentar realizar/ou assistir uma tarefa sendo realizada. A tentativa do método das Bio-âncoras de fazer isso é a parte mais controversa da análise, segundo os revisores técnicos do método até agora.

Podemos pensar no método das Bio-âncoras como dizendo:

- Existem algumas tarefas que um ser humano faz com apenas um segundo de pensamento, como, por exemplo, reconhecer imagens de gatos ou cachorros.

- Existem outras tarefas que levam vários minutos para um ser humano pensar, tal como, resolver um quebra-cabeça lógico.

- Outras tarefas podem levar horas, dias, meses ou até anos e exigem não apenas pensar, mas interagir com o ambiente. Como, por exemplo, escrever um artigo científico.

- As tarefas na extremidade mais longa desse espectro serão mais caras de se tentar realizar/assistir, portanto, será mais caro treinar um modelo de Inteligência Artificial para realizar essas tarefas. Por exemplo, é mais caro (leva mais tempo e mais dinheiro) realizar um milhão de “tentativas” de uma tarefa com uma hora de duração, do que um milhão de “tentativas” de realizar uma tarefa que leva apenas um segundo.

- No entanto, a teoria não é tão simples quanto parece. Muitas tarefas que parecem “longas” (como escrever uma redação) podem, na verdade, ser divididas em uma série de tarefas “mais curtas” (como escrever frases individuais).

- Se um modelo de Inteligência Artificial puder ser treinado para executar uma “sub-tarefa” mais curta, ele poderá realizar a tarefa mais longa simplesmente repetindo a subtarefa mais curta várias vezes – sem nunca precisar ser explicitamente “treinado” para fazer a tarefa mais longa.

- Por exemplo, um modelo de Inteligência Artificial poderia realizar um milhão de tentativas da seguinte tarefa: “Leia um ensaio parcialmente finalizado e escreva uma boa frase seguinte.” Se o modelo aprender a fazer bem essa tarefa, ele poderá escrever um ensaio longo simplesmente repetindo essa tarefa indefinidamente. Ele não precisaria de um processo de treinamento separado, onde realizaria um milhão de “tentativas” da tarefa mais demorada de escrever um ensaio inteiro.

- Portanto, torna-se crucial que tarefas mais difíceis e importantes (como as listadas acima) possam ser “decompostas” em tarefas curtas/fáceis.

Estimando os custos

O método das Bio-âncoras analisa o custo de treinamento dos modelos de Inteligência Artificial existentes, dependendo do tamanho do modelo e do tipo de tarefa (conforme definido acima). Em seguida, extrapola os valores para estimar quanto custaria treinar um modelo de Inteligência Artificial se:

- Ele fosse 10 vezes maior que um cérebro humano.101

- Se as “tentativas” de realizar a tarefa exigissem dias, semanas ou meses de “raciocínio” intensivo.

Atualmente, esse tipo de treinamento custaria cerca de um milhão de trilhões de dólares, o que é muito mais do que a riqueza mundial total. Portanto, não me surpreende que ninguém tenha tentado treinar tal modelo até hoje.

No entanto, o método das Bio-âncoras também prevê as seguintes tendências para o futuro:

- Avanços em hardware e software que tornariam o poder de computação mais barato.

- Uma economia em crescimento e um papel crescente da Inteligência Artificial na economia, podem aumentar o orçamento dos laboratórios de Inteligência Artificial para US$ 1 trilhão ou mais destinados ao treinamento de modelos maiores.

De acordo com essas projeções, em algum momento “o orçamento dos laboratórios de IA” se tornará igual ao valor necessário para se “treinar um modelo do tamanho de um cérebro humano nas tarefas mais difíceis”. O método das Bio-âncoras baseia suas projeções para “quando a Inteligência Artificial transformadora será desenvolvida” no tempo em que esse investimento acontecer.

O método das Bio-âncoras também modela a incerteza em todos os parâmetros acima e considera abordagens alternativas para os parâmetros de “tamanho do modelo e tipo de tarefa”102 Ao fazer isso, ele estima que a Inteligência Artificial transformadora será desenvolvida até 2030, 2035, etc.

Agressivo ou conservador?

O método das Bio-âncoras envolve uma série de simplificações que podem torná-lo muito agressivo (esperar que a Inteligência Artificial transformadora chegue mais cedo do que é realista) ou muito conservador (esperar que chegue mais tarde do que é realista).

O argumento que mais ouço de que ele é “muito agressivo” é neste sentido: “Não há razão para pensar que uma Inteligência Artificial baseada em métodos modernos pode aprender tudo o que um ser humano faz, usando treinamento de tentativa e erro — não importa se o modelo é grande ou o quanto ele foi treinado. Os cérebros humanos podem raciocinar de maneiras exclusivas, inigualáveis e incomparáveis a qualquer IA, a menos que criemos abordagens fundamentalmente novas para a IA.” Esse tipo de argumento costuma ser acompanhado por falas de que os sistemas de Inteligência Artificial não “entendem verdadeiramente” sobre o que estão raciocinando e/ou que eles estão apenas imitando o raciocínio humano por meio do reconhecimento de padrões.

Acho que isso pode acabar sendo correto, mas eu não apostaria nisso.

Uma discussão completa do porquê isso está fora do escopo desta postagem, mas em resumo:

- Não estou convencido de que haja uma distinção profunda ou estável entre “reconhecimento de padrões” e “compreensão verdadeira” (este artigo da Slate Star Codex defende esse argumento). A “compreensão verdadeira” pode simplesmente ser a representação de como seria um reconhecimento de padrões excelentes. Parte do meu raciocínio aqui se baseia numa intuição de que mesmo quando as pessoas (incluindo eu) parecem “entender” algo superficialmente, seu raciocínio frequentemente (eu diria até normalmente) falha ao considerar um contexto desconhecido. Em outras palavras, acredito que o que consideramos “compreensão verdadeira” é mais um ideal do que uma realidade.

- Sinto-me desapontado com o histórico daqueles que fizeram esse tipo de argumento —não acredito que eles tenham conseguido identificar o que é o “raciocínio verdadeiro”, de modo que pudessem fazer previsões robustas sobre quais tarefas seriam difíceis para sistemas de Inteligência Artificial realizarem. (Por exemplo, veja esta discussão da crítica mais recente de Gary Marcus ao GPT3).

- Pode ser verdade que “Algumas descobertas/avanços fundamentais são necessários”. Mas para que o Bio-âncoras seja considerado excessivamente agressivo, não basta que alguns avanços sejam necessários; os avanços necessários devem ser mais do que os cientistas de Inteligência Artificial conseguirão conquistar nas próximas décadas, período no qual o método das Bio-âncoras prevê o desenvolvimento da Inteligência Artificial transformadora. Parece difícil acreditar que as coisas acontecerão dessa maneira – especialmente porque:

- Mesmo avanços moderados em sistemas de IA, teriam o potencial de atrair mais talento e financiamento para a área (como já está acontecendo103).

Se o dinheiro, o talento e o poder de processamento forem abundantes e o progresso em direção ao PASTA for impedido, principalmente por alguma fraqueza específica decorrente de como os sistemas de Inteligência Artificial são projetados e treinados, uma tentativa sustentada dos pesquisadores de corrigir essa fraqueza pode funcionar. Quando nos referimos a cronologias de várias décadas, isso pode ser tempo suficiente para os pesquisadores descobrirem o que está faltando nas técnicas atuais.

De forma mais ampla, o Bio-âncoras pode ser considerado agressivo demais devido à sua suposição de que “o poder computacional é o gargalo”:

- Ele pressupõe que, se alguém pudesse pagar por todo o poder computacional necessário para fazer o “treinamento” de força bruta para as tarefas principais (por exemplo, automatizar o trabalho científico), a Inteligência Artificial transformadora (provavelmente) seria desenvolvida em seguida.

- Treinar um modelo de Inteligência Artificial não requer apenas comprar mais poder computacional. Requer contratar pesquisadores, realização de experimentos e, talvez o mais importante, encontrar uma maneira de configurar o processo de “tentativa e erro” para a Inteligência Artificial poder realizar inúmeras tentativas da tarefa principal. Isso pode acabar sendo difícil demais de ser feito.

Por outro lado, existem várias razões para considerar o método das Bio-âncoras conservador demais (subestimando a probabilidade da Inteligência Artificial transformadora ser desenvolvida em breve).

- Talvez com engenhosidade suficiente, alguém crie uma Inteligência Artificial transformadora “programando-a” para realizar tarefas principais, em vez de ter que “treiná-la” (veja acima para a distinção). Isso exigiria muito menos poder computacional e, portanto, seria muito menos dispendioso. Ou então, seria possível usar uma combinação de “programação” e “treinamento” para aumentar a eficiência sugerida pelo método, sem que fosse necessário realizar tudo via “programação”.

- Poderíamos desenvolver abordagens muito superiores à Inteligência Artificial que seriam “treinadas” com muito mais eficiência. Uma possibilidade aqui é o meta-aprendizado: treinar efetivamente um sistema de Inteligência Artificial na “tarefa” de treinar a si mesmo.

- Ou talvez, com o tempo, a Inteligência Artificial torne-se uma parte crescente da economia, resultando na proliferação de diferentes sistemas de IA personalizados e nos quais se investiu para eles realizarem diferentes tarefas reais. Quanto mais isso acontecer, mais oportunidades existirão para que a engenhosidade individual e a sorte resultem em mais inovações e sistemas de Inteligência Artificial mais capazes em contextos econômicos específicos.

- Talvez em algum momento seja possível integrar muitos sistemas com habilidades diferentes para enfrentar uma tarefa particularmente difícil como “automatizar a ciência”, sem a necessidade de uma “rodada de treinamentos” astronomicamente cara.

- Ou talvez a Inteligência Artificial que fica aquém do PASTA ainda seja útil o suficiente para gerar muito dinheiro e/ou ajudar os pesquisadores a baixar os custos da computação e aumentar a sua eficiência. Isso, por sua vez, levaria a modelos de Inteligência Artificial ainda maiores que aumentariam ainda mais a disponibilidade de dinheiro e a eficiência da computação. Isso tornaria uma rodada de treinamento no nível PASTA mais econômica, antes do que o método das âncoras biológicas prevê.

- Além disso, alguns revisores técnicos do método acham que seu tratamento de tipo de tarefa é conservador demais. Eles acreditam que as tarefas mais importantes (e talvez todas as tarefas) nas quais a Inteligência Artificial precisa ser treinada estarão no extremo “mais fácil/mais barato” do espectro, em comparação com o que o Bio-âncoras presume. (Veja a seção acima para o que significa quando uma tarefa é “mais fácil/mais barata” ou “mais difícil/mais cara”). Para um argumento relacionado, veja Fun with +12 OOMs of Compute (Diversão com mais de 12 ordens de magnitude de Computação), que argumenta intuitivamente que o método das Bio-âncoras está imaginando uma quantidade verdadeiramente massiva de poder computacional necessário para criar o PASTA, e que menos do que o método imagina poderia ser o suficiente.

Não acho que seja óbvio se, no geral, o método das Bio-âncoras é muito agressivo (quando presume que a Inteligência Artificial transformadora ocorrerá mais cedo do que é realista) ou muito conservador (presumindo que ela será desenvolvida mais tarde). O próprio relatório afirma que é provável que ele esteja sendo muito agressivo ao prever o desenvolvimento da Inteligência Artificial transformadora nos próximos anos e, muito conservador estimando um prazo maior que 50 anos, e provavelmente suas estimativas sejam mais úteis se estiverem entre esses dois períodos.104

Intelectualmente, parece-me que é mais provável que o relatório seja conservador. Acho suas respostas aos argumentos acima, de que o método é “muito agressivo”, bastante convincentes, e acredito que os argumentos de que ele seja “muito conservador” têm mais chances de estarem corretos. Particularmente, acredito difícil descartar a possibilidade de que a engenhosidade leve à Inteligência Artificial transformadora de uma maneira muito mais eficiente do que o método de “força bruta” contemplado aqui. E acredito que o tratamento do “tipo de tarefa” está definitivamente errando numa direção mais conservadora.

No entanto, também tenho uma preferência intuitiva (que está relacionada às análises de “ônus da prova” dadas anteriormente) para errar para o lado mais conservador ao fazer estimativas como essa. No geral, meus melhores palpites sobre cronologias da Inteligência Artificial transformadora são semelhantes às do método das Bio-âncoras.

Conclusões sobre o método das Bio-âncoras

O método estima uma probabilidade >10% do desenvolvimento da Inteligência Artificial transformadora até 2036, aproximadamente 50% até 2055 e aproximadamente 80% até 2100.

Também vale a pena ressaltar o que o relatório diz sobre os sistemas de Inteligência Artificial atuais. Ele estima que:

- Os maiores modelos de Inteligência Artificial atuais, como, por exemplo, o GPT-4o, são um pouco menores que os cérebros de camundongos e estão começando a ficar nos padrões de tamanho (se crescessem de 100 a 1000 vezes) dos cérebros humanos. Portanto, em breve chegaremos perto de desenvolver sistemas de Inteligência Artificial que serão treinados para fazer qualquer coisa que os humanos consigam fazer com cerca de 1 segundo de pensamento. Consistente com isso, parece-me que estamos apenas começando a chegar ao ponto no qual os modelos de linguagem soam como humanos falando espontaneamente.105 Na verdade, um “humano que não pensa mais do que 1 segundo antes de cada palavra” parece próximo do que o GPT-3 consegue fazer atualmente, embora ele seja muito menor do que um cérebro humano.

- Só muito recentemente os modelos de Inteligência Artificial ficaram desse tamanho. Um modelo de Inteligência Artificial “grande” antes de 2020 teria um tamanho mais próximo do tamanho do cérebro de uma abelha. Portanto, mesmo a respeito de modelos recentes, deveríamos estar nos perguntando se os sistemas de Inteligência Artificial parecem ser “tão inteligentes quanto os insetos”. Aqui está uma tentativa de comparar as habilidades de uma abelha com as da Inteligência Artificial (de Guille Costa, estagiário na Open Philanthropy), que conclui que algumas das habilidades mais impressionantes das abelhas, como o autor argumenta, parecem ser executáveis por sistemas de IA.106

Incluo estas observações porque:

- A análise do método das Bio-âncoras parece totalmente consistente com o que estamos observando nos sistemas de Inteligência Artificial atuais (e das últimas duas décadas), ao mesmo tempo, em que sugere que provavelmente desenvolveremos mais habilidades transformadoras nas próximas décadas.

- Acho particularmente digno de nota que estamos chegando perto do momento em que um modelo de Inteligência Artificial será “tão grande quanto um cérebro humano” (segundo o método de estimativa da Computação cerebral /método das Bio-âncoras). Pode acontecer que tal modelo de Inteligência Artificial seja capaz de “aprender” muito sobre o mundo e produzir muito valor econômico, mesmo que ainda não consiga fazer as coisas mais difíceis que os humanos conseguem fazer. E isso, por sua vez, poderia impulsionar investimentos vertiginosos em Inteligência Artificial (tanto em dinheiro, quanto em talento), levando a muito mais inovação e avanços. Esta é uma razão simples para acreditar que o desenvolvimento da Inteligência Artificial transformadora até 2036 é plausível.

Finalmente, ressalto que o método das Bio-âncoras inclui uma análise de “evolução” entre as diferentes abordagens que considera. Esta análise levanta a hipótese de que, para produzir a Inteligência Artificial transformadora, seria necessário fazer tantos cálculos quanto todos os animais da história juntos já fizeram, a fim de recriar o progresso realizado pela seleção natural.

Considero a análise de “evolução” muito conservadora, porque o aprendizado de máquina consegue progredir muito mais rapidamente do que o tipo de tentativa e erro associado à seleção natural. Mesmo que alguém acredite em algo como “Os cérebros humanos raciocinam de maneiras únicas, inigualáveis e incomparáveis com uma Inteligência Artificial moderna”, parece que tudo o que é exclusivo aos cérebros humanos poderia ser redescoberto se alguém conseguisse, essencialmente, reexecutar toda a história da seleção natural. E mesmo essa análise muito conservadora estima uma chance de aproximadamente 50% da Inteligência Artificial transformadora ser desenvolvida até 2100.

Prós e contras do método das âncoras biológicas para prever cronologias da Inteligência Artificial transformadora

Contras. Começarei com o que vejo como a maior desvantagem do método: esta é uma estrutura de previsão muito complexa, que depende crucialmente de várias estimativas e suposições extremamente incertas, particularmente:

- Se é razoável acreditar que um sistema de Inteligência Artificial pode aprender as principais tarefas listadas acima (as necessárias para o PASTA) com treinamento de tentativa e erro suficiente.

- Como comparar o tamanho dos modelos de Inteligência Artificial com o tamanho dos cérebros de animais/humanos.

- Como caracterizar o “tipo de tarefa”, estimando o quanto ela é “difícil” e cara de se “tentar” realizar ou “assisti-la” sendo realizada uma vez.

- Como usar o tamanho do modelo e o tipo de tarefa para estimar quanto custaria treinar um modelo de Inteligência Artificial para realizar as tarefas consideradas principais.

- Como estimar avanços futuros em hardware e software que poderiam baratear os custos com poder computacional.

- Como estimar aumentos futuros nos orçamentos de laboratórios de Inteligência Artificial destinados ao treinamento de modelos.

Esse tipo de complexidade e incerteza significa (na minha opinião), que não devemos considerar essas previsões como sendo confiáveis, especialmente hoje, quando o método ainda é relativamente novo. Se chegássemos ao ponto em que tanto escrutínio e esforço tivessem sido dedicados à previsão de Inteligência Artificial quanto é dedicado à previsão do clima, tudo isso poderia ser uma questão bem diferente.

Prós. Dito isso, o método das âncoras biológicas é, essencialmente, o único que conheço que fornece estimativas de cronologias de Inteligência Artificial transformadora a partir de fatos objetivos (quando possível) e suposições explícitas (em outros lugares).107 Ele não depende de nenhum conceito vago e intuitivo como o conceito de “quão rapidamente os sistemas de Inteligência Artificial estão ficando mais surpreendentes (discutido anteriormente). Cada suposição e estimativa do método podem ser explicadas, discutidas e – ao longo do tempo – testadas.

Mesmo em seu atual estágio inicial de desenvolvimento, considero isso uma propriedade valiosa do método das âncoras biológicas. Isso significa que, esse método poderia fornecer estimativas de cronologias que não são simplesmente reformulações de intuições sobre se parece que o desenvolvimento da Inteligência Artificial transformadora está próximo de acontecer.108

Também acho encorajador que, mesmo com todas as especulações, as “previsões” verificáveis que o método realiza atualmente parecem razoáveis (consulte a seção anterior). O método propõe uma maneira de pensar sobre como pode ser simultaneamente verdadeiro que (a) os sistemas de Inteligência Artificial de uma década atrás não pareciam muito surpreendentes; (b) os sistemas de Inteligência Artificial atuais conseguem fazer muitas coisas surpreendentes, mas parecem ainda muito aquém do que os humanos conseguem fazer; (c) o desenvolvimento da Inteligência Artificial transformadora poderá, facilmente, acontecer nas próximas décadas — ou mesmo nos próximos 15 anos.

Além disso, acredito que vale a pena destacar alguns argumentos de alto nível apresentados pelo método das Bio-âncoras que não dependem de tantas estimativas e suposições:

- Na próxima década, provavelmente desenvolveremos – pela primeira vez – modelos de Inteligência Artificial com “tamanho” comparável ao do cérebro humano.

- Se os modelos de Inteligência Artificial continuarem a se tornar maiores e mais eficientes na proporção que o método das Bio-âncoras estima, provavelmente será possível atingir alguns marcos bastante extremos, ainda neste século, com um custo acessível – o “ponto alto” daquilo que o método das Bio-âncoras acredita ser necessário. Estes pontos são difíceis de resumir aqui, mas consulte os métodos de “rede neural de longo prazo” e “âncora de evolução” no relatório.

- Uma maneira de pensar sobre isso é a de que no próximo século passaremos provavelmente de uma “computação insuficiente para executar um modelo com o tamanho do cérebro humano” para um “poder computacional extremamente abundante, até maior do que algumas estimativas conservadoras acreditam que seria necessário.” O poder computacional não é o único fator de influência no progresso da IA, mas na medida em que outros fatores (algoritmos, processos de treinamento) se tornam os novos gargalos, provavelmente haverá incentivos poderosos (e várias décadas) para conseguirmos resolvê-los.

Uma vantagem final do método das Bio-âncoras é que podemos continuar a observar o progresso da Inteligência Artificial ao longo do tempo e comparar o que vemos com o apresentado no relatório. Podemos observar, por exemplo:

- Se existem tarefas que simplesmente não podem ser aprendidas, mesmo com muita tentativa e erro — ou se algumas tarefas exigem quantidades de treinamento muito diferentes do que o relatório prevê.

- Como as habilidades dos modelos de Inteligência Artificial se comparam às dos animais que atualmente usamos como referência de “tamanhos semelhantes”. Se os modelos de Inteligência Artificial parecem mais capazes do que esses animais, podemos estar superestimando o tamanho que um modelo precisaria para, por exemplo, automatizar a ciência. Se eles parecerem menos capazes, podemos estar subestimando isso.

- Como o hardware e o software estão progredindo e se os modelos de Inteligência Artificial estão ficando maiores na proporção que o relatório projeta atualmente.

O próximo artigo resumirá todas as diferentes análises feitas até o momento sobre as cronologias da Inteligência Artificial transformadora. Ele então discutirá uma ressalva que permanece: que não há um consenso robusto de especialistas sobre esse tópico.

Notas

96Claro, a resposta poderia ser “Daqui a um zilhão de anos” ou “Nunca.”

97Para fins de transparência, observe que esta é uma análise feita pela Open Philanthropy, e sou co-CEO da Open Philanthropy.

98Geralmente, considero (assim como o método das Bio-âncoras), o número de sinapses mais importante do que o de neurônios, por razões que não vou abordar aqui.

99Wikipedia: “A versão completa do GPT-3 tem capacidade para 175 bilhões de parâmetros de aprendizado de máquina… Antes do lançamento do GPT-3, o maior modelo de linguagem era o Turing NLG da Microsoft, lançado em fevereiro de 2020, com capacidade para 17 bilhões de parâmetros.” A Wikipedia não afirma isso, mas não acredito que existam modelos de Inteligência Artificial conhecidos publicamente maiores do que esses modelos de linguagem (com exceção dos modelos “mistura de especialistas” que acredito que devemos desconsiderar para esses propósitos, por motivos que não vou abordar aqui) A Wikipedia estima cerca de 1 trilhão de sinapses para o cérebro de um rato-doméstico; O método das âncoras biológicas para comparações cerebrais (baseada em Computação cerebral) essencialmente iguala sinapses a parâmetros.

100O método das âncoras biológicas estima cerca de 100 trilhões de parâmetros para o cérebro humano, com base no fato de que ele possui cerca de 100 trilhões de sinapses.

101O tamanho de 10 vezes maior foi escolhido para deixar algum espaço para a ideia de que “cérebros digitais” podem ser menos eficientes que os cérebros humanos. Veja esta seção do relatório.

102Por exemplo, uma abordagem levanta a hipótese de que o treinamento poderia ser barateado pelo meta- aprendizado, discutido acima; outra abordagem levanta a hipótese de que, para produzir Inteligência Artificial transformadora, seria necessário fazer tantos cálculos quanto todos os animais da história combinados, a fim de recriar o progresso feito pela seleção natural.)

103Veja os gráficos das primeiras seções do 2021 AI Index Report, por exemplo.

104Veja esta seção.

105Para uma coleção de links para demos do GPT-3, veja esta postagem.

106Ele estima que os sistemas de Inteligência Artificial parecem usar cerca de 1000 vezes menos poder computacional, o que corresponderia ao argumento acima em termos de sugerir que os sistemas de Inteligência Artificial podem ser mais eficientes do que os cérebros de animais/humanos e que as estimativas do método das Bio-âncoras podem ser muito conservadoras. Porém, ele não aborda que as abelhas executam um conjunto mais diversificado de tarefas do que os sistemas de Inteligência Artificial aos quais estão sendo comparadas.

107Além do método de “priori semi-informativas” discutido anteriormente.

108Claro, isso não quer dizer que as estimativas sejam completamente independentes das intuições —é provável que as intuições influenciem nossas escolhas de estimativas para muitos dos números que são difíceis de estimar. Mas a capacidade de analisar e debater cada estimativa separadamente é útil aqui.