Esta postagem foi escrita, a convite meu, por Ajeya Cotra

Holden mencionou anteriormente a ideia de que sistemas avançados de Inteligência Artificial (por exemplo, o PASTA) poderiam desenvolver objetivos perigosos que os levariam a enganar ou enfraquecer os humanos. Isso pode soar como uma preocupação bastante exagerada. Por que programaríamos uma Inteligência Artificial que quer nos prejudicar? Mas acredito que isso pode ser um problema difícil de evitar, especialmente se a Inteligência Artificial avançada for desenvolvida usando deep learning (aprendizagem profunda) (a qual é muitas vezes usada para desenvolver Inteligência Artificial de última geração hoje em dia).

Na aprendizagem profunda, não programamos um computador manualmente para realizar uma tarefa. De uma forma bem resumida, em vez disso, procuramos por uma aplicação (chamado de modelo) que execute bem essa tarefa. Normalmente sabemos muito pouco sobre o funcionamento interno do modelo com o qual terminamos, apenas que ele parece estar fazendo um bom trabalho. É mais parecido com contratar e treinar um funcionário do que construir uma máquina.

Assim como os funcionários humanos podem ter muitas motivações diferentes para fazer seu trabalho (desde acreditar na missão da empresa até gostar do trabalho que faz no dia a dia ou apenas querer dinheiro), os modelos de aprendizagem profunda também podem ter muitas “motivações” diferentes. E todas essas motivações convergem para um bom desempenho em uma determinada tarefa. Como eles não são humanos, suas motivações podem ser muito estranhas e difíceis de prever – como se fossem funcionários alienígenas.

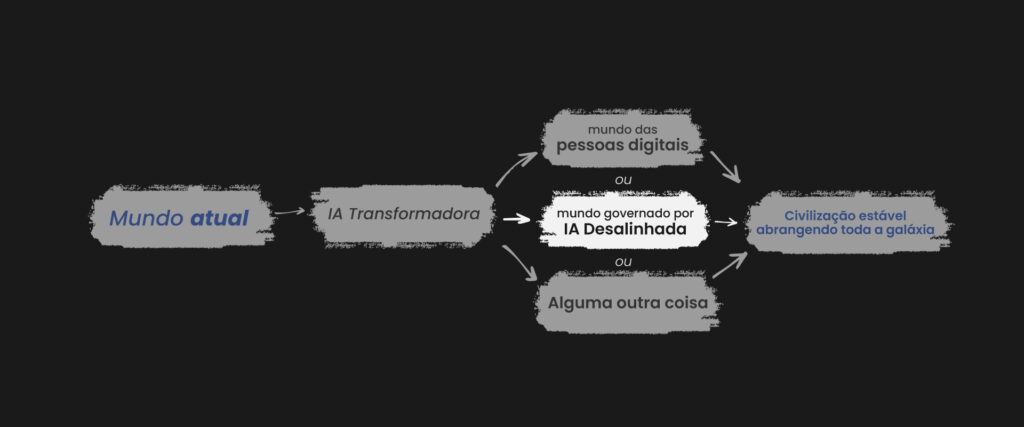

Já estamos começando a ver evidências preliminares de que os modelos às vezes perseguem objetivos que seus designers não pretendiam (aqui e aqui). No momento, isso não é perigoso. Mas se isso continuar a acontecer com modelos muito poderosos,

podemos acabar em uma situação em que a maioria das decisões importantes – incluindo que tipo de civilização em escala galáctica almejar – seriam feitas por modelos sem muita consideração pelo que os humanos valorizam.

O problema do alinhamento da deep learning (aprendizagem profunda) consiste em garantir que modelos avançados de aprendizagem profunda não persigam objetivos perigosos. No restante desta postagem:

- Desenvolverei uma analogia de “contratação” para ilustrar como o alinhamento poderia ser difícil se os modelos de aprendizagem profunda fossem mais capazes do que os humanos (mais).

- Explicarei o que é o problema de alinhamento da aprendizagem profunda com um pouco mais de detalhes técnicos (mais).

- Discutirei o quanto o problema de alinhamento pode ser difícil de resolver e quanto risco existe em não o resolver.(mais).

Analogia: o jovem CEO

Nesta seção, usarei uma analogia na tentativa de ilustrar intuitivamente porque poderia ser difícil evitar o desalinhamento em um modelo muito poderoso. Não é uma analogia perfeita; seu objetivo é apenas tentar transmitir algumas intuições.

Imagine que você é uma criança de oito anos cujos pais lhe deixaram uma empresa de US$ 1 trilhão e nenhum adulto de confiança para servir como seu guia para o mundo. Você deve contratar um adulto inteligente para administrar sua empresa como CEO e tomar conta da sua vida como os seus próprios pais fariam. Esse adulto decidirá, dentre outras coisas, em qual escola você estudará, onde morará, quando você precisará ir ao dentista; além de administrar sua vasta riqueza (por exemplo, decidir onde você investirá seu dinheiro).

Você terá que contratar esse adulto com base em um teste ou entrevista de trabalho da própria criação — você não terá acesso a currículos, referências, etc. Como você é muito rico, muitas pessoas se candidatam a vaga, pelos mais variados motivos.

Seu grupo de candidatos inclui:

- Santos — pessoas que realmente querem apenas o ajudar a administrar bem sua propriedade e cuidar de seus interesses de longo prazo.

- Bajuladores — pessoas que só querem fazer o que for preciso para te fazer feliz a curto prazo ou seguir suas instruções literalmente, independentemente das consequências a longo prazo.

- Calculistas — pessoas com interesses próprios que desejam ter acesso à sua empresa, à sua riqueza e ao seu poder para usá-los como quiserem.

Como você tem apenas oito anos, você provavelmente seria péssimo em elaborar um processo seletivo adequado, então você facilmente acabaria contratando um Bajulador ou um Calculista:

- Você poderia pedir que cada candidato explicasse quais estratégias de alto nível eles seguiriam (como investiriam, qual seria o plano de negócios da empresa para os próximos cinco anos, como escolheriam sua escola) e porque essas seriam as melhores opções, e, assim, escolher aquele cujas explicações parecessem fazer mais sentido para você.

- Porém, você seria incapaz de entender, realmente, quais das estratégias declaradas são as melhores. Então, você poderia acabar contratando um Bajulador com uma estratégia terrível que parecesse boa para você, que executaria fielmente essa estratégia e quebraria a sua empresa.

- Você também poderia acabar contratando um Calculista que diria o que fosse preciso para ser contratado e faria o que quisesse quando você não estivesse monitorando.

- Você poderia tentar demonstrar como tomaria todas as decisões e escolheria a pessoa que parecesse tomar decisões da maneira mais semelhante possível a você.

- Entretanto, se você realmente acabasse contratando um adulto que sempre faria tudo o que uma criança de oito anos faria (um Bajulador), sua empresa provavelmente não sobreviveria.

- De qualquer forma, você poderia acabar contratando um adulto que simplesmente fingisse fazer tudo do jeito que você faria, mas que, na verdade, fosse um Calculista que planejasse mudar de rumo assim que conseguisse o emprego.

- Você poderia dar a vários adultos o controle temporário da sua empresa e da sua vida e observá-los tomar decisões por um longo período (supondo que eles não conseguiriam tirar o controle da empresa de você durante este teste). Você poderia então contratar a pessoa que parecesse fazer as coisas se saírem melhor para você — quem quer que o fizesse mais feliz, quem parecesse aumentar mais a sua conta bancária, etc.

- Novamente, não teria como você saber se contratou um Bajulador (que faria o que fosse preciso para deixar seu eu de oito anos ignorante e feliz sem considerar as consequências a longo prazo) ou um Calculista (que faria o que fosse preciso para ser contratado e planejasse mudar tudo assim que conseguisse o emprego).

Qualquer estratégia que você pudesse criar, acabaria facilmente com você contratando e colocando todo o controle funcional nas mãos de um Bajulador ou um Calculista.

Para quaisquer efeitos práticos, caso você não conseguisse contratar um Santo — e especialmente se contratasse um Calculista — logo você não seria realmente o CEO de uma empresa gigante. No momento que você se tornasse adulto e percebesse o erro que cometeu, é muito provável que você estivesse falido e não conseguisse reverter essa situação.

Nesta analogia:

- O garoto de 8 anos é um humano tentando treinar um modelo poderoso de aprendizagem profunda. O processo de contratação é análogo ao processo de treinamento, que busca implicitamente dentre uma grande variedade de modelos possíveis e, então, escolhe aquele que obtém bom desempenho.

- O único método usado pelo garoto de 8 anos para avaliar os candidatos envolve observar seu comportamento externo, o que, atualmente, é o nosso principal método de treinamento de modelos de aprendizagem profunda (já que seu funcionamento interno é amplamente inescrutável).

- Modelos muito poderosos conseguiriam facilmente “manipular” qualquer teste que os humanos pudessem elaborar, assim como os candidatos a vaga de CEO poderiam facilmente manipular qualquer processo seletivo que a criança de 8 anos conseguisse elaborar.

- O “Santo” seria um modelo de aprendizagem profunda que pareceria ter um bom desempenho porque teria exatamente os objetivos que gostaríamos que ele tivesse. O “Bajulador” seria um modelo que pareceria ter um bom desempenho porque ele buscaria aprovação de curto prazo de maneiras que não seriam boas a longo prazo. E o “Calculista” seria um modelo que pareceria ter um bom desempenho porque um bom desempenho durante o treinamento lhe daria mais oportunidades de perseguir seus próprios objetivos futuramente. Qualquer um desses três tipos de modelos poderia emergir do processo de treinamento.

Na próxima seção, entrarei em mais detalhes sobre como a aprendizagem profunda funciona e explicarei por que Bajuladores e Calculistas poderiam surgir ao tentarmos treinar um modelo poderoso de aprendizagem profunda, como o PASTA.

Como os problemas de alinhamento podem surgir na aprendizagem profunda

Nesta seção, conectarei a analogia aos processos de treinamento reais para aprendizagem profunda, ao:

- Resumir brevemente como a aprendizagem profunda funciona (mais).

- Ilustrar como os modelos de aprendizagem profunda geralmente obtêm bom desempenho de maneiras estranhas e inesperadas (mais).

- Explicar porque modelos poderosos de aprendizagem profunda podem obter bom desempenho agindo como Bajuladores ou Calculistas (mais).

Como a aprendizagem profunda funciona em alto nível

Esta é uma explicação simplificada que dá uma ideia geral do que é a aprendizagem profunda. Veja esta postagem para uma explicação mais detalhada e tecnicamente precisa.

A aprendizagem profunda envolve essencialmente a busca pela melhor maneira de organizar um modelo de rede neural — que é como um “cérebro” digital com muitos neurônios digitais conectados mutualmente com conexões de intensidades variadas, para fazê-lo executar bem uma determinada tarefa. Esse processo é chamado de treinamento e envolve muitas tentativas e erros.

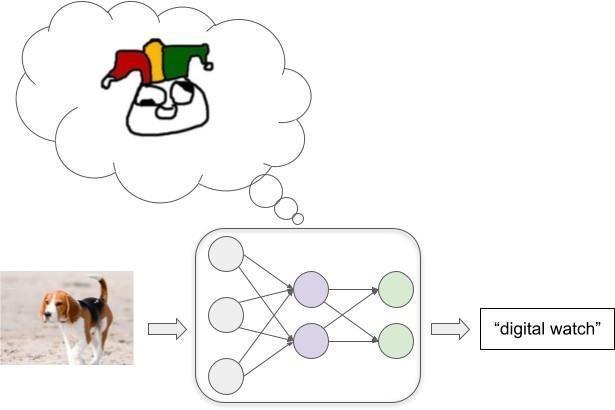

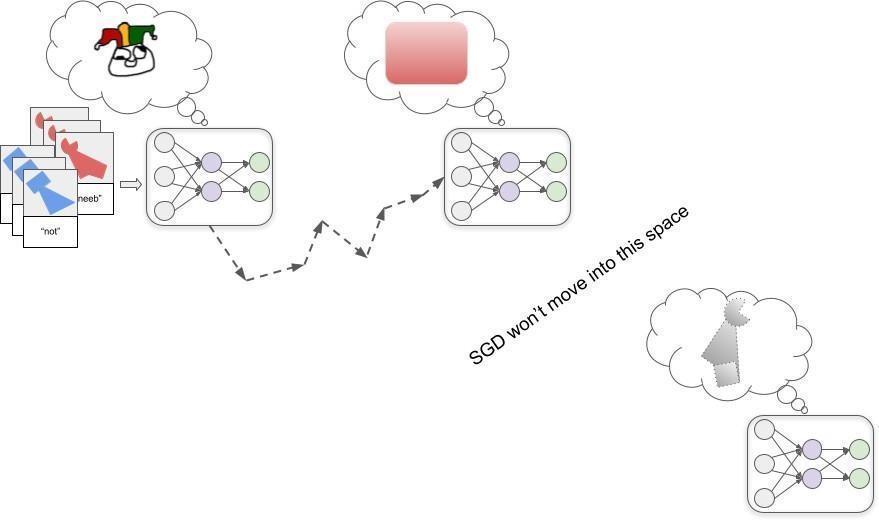

Imaginemos que estamos tentando treinar um modelo para classificar imagens bem. Começamos com uma rede neural onde todas as conexões entre os neurônios têm forças aleatórias. Este modelo rotula as imagens de forma totalmente incorreta:

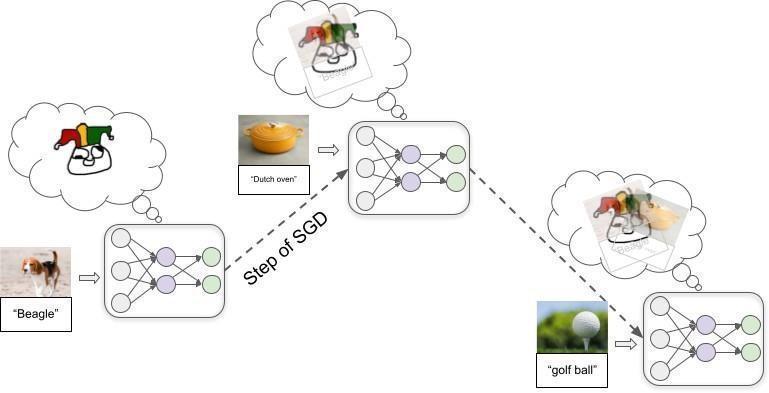

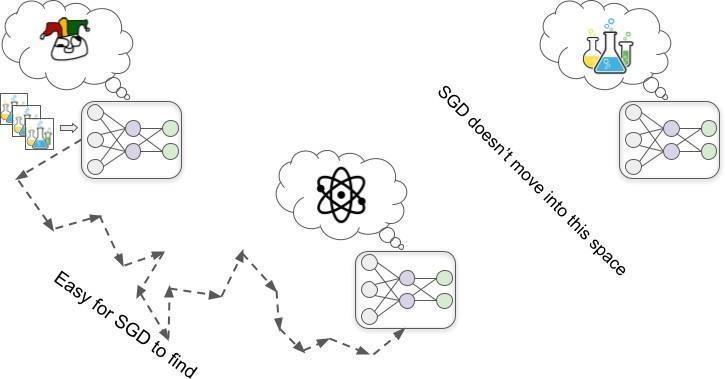

Em seguida, alimentamos o modelo com inúmeros exemplos de imagens, deixando que ele tente repetidamente rotular um exemplo e, em seguida, informamos para ele qual é o rótulo correto. Enquanto fazemos isso, as conexões entre os neurônios são ajustadas repetidamente por meio de um processo chamado gradiente descendente estocástico (SGD). A cada exemplo, o SGD fortalece ligeiramente algumas conexões e enfraquece outras para melhorar um pouco o desempenho:

Uma vez que o modelo estiver alimentado com milhões de exemplos, ele fará um bom trabalho ao rotular imagens semelhantes no futuro.

Além da classificação de imagens, a aprendizagem profunda é usada para produzir modelos que reconhecem a fala, jogam jogos de tabuleiro e videogames, geram textos, imagens, e músicas bastante realistas, controlam robôs, e muito mais. Em cada caso, começamos com um modelo de rede neural conectado aleatoriamente e, em seguida:

- Alimentamos o modelo com um exemplo da tarefa que queremos que ele execute.

- Damos a ele algum tipo de pontuação numérica (geralmente chamada de recompensa) que reflita o desempenho dele no exemplo.

- Usamos SGD para ajustar o modelo para aumentar quanta recompensa ele teria recebido.

Essas etapas são repetidas milhões ou bilhões de vezes até chegarmos a um modelo que obterá alta recompensa em futuros exemplos semelhantes aos observados no treinamento.

Os modelos alcançam bom desempenho de maneiras inesperadas.

Esse tipo de processo de treinamento não nos dá muitos insights sobre como o modelo obtém um bom desempenho. Geralmente, existem várias maneiras de obter um bom desempenho, e a maneira que o SGD geralmente encontra não é intuitiva.

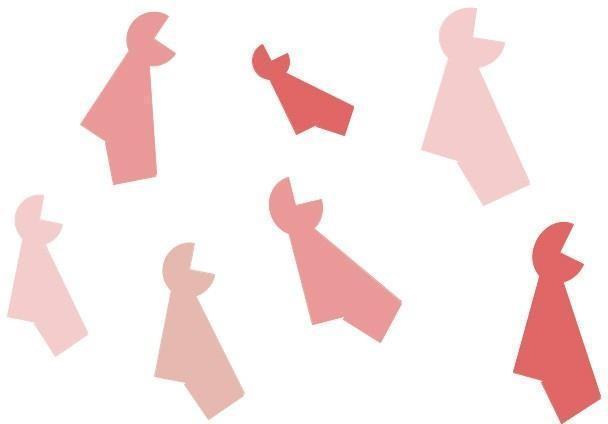

Ilustraremos com um exemplo. Imagine que eu disse para você que esses objetos são todos “thneebs”:

Agora, qual desses dois objetos é um “thneeb”?

Você provavelmente sente intuitivamente que o objeto à esquerda é o “thneeb”, porque você está acostumado a considerar a forma mais importante do que a cor para determinar a identidade de algo. Mas os pesquisadores descobriram que as redes neurais geralmente

fazem a suposição oposta. Uma rede neural treinada com um monte de “thneebs” vermelhos rotularia provavelmente o objeto à direita como um “thneeb”.

Não sabemos exatamente o porquê, mas por alguma razão é “mais fácil” para o SGD encontrar um modelo que reconheça uma cor específica do que um que reconheça uma forma específica. E se o SGD encontrar primeiro o modelo que reconhece perfeitamente o vermelho, não há muito mais incentivo para “continuar procurando” o modelo de reconhecimento de forma, pois o modelo de reconhecimento da cor vermelha terá precisão perfeita nas imagens vistas no treinamento:

Se os programadores esperavam obter o modelo de reconhecimento de forma, eles podem considerar isso um fracasso. Mas é importante reconhecer que não haveria erro ou falha logicamente dedutível se tivéssemos o modelo de reconhecimento da cor vermelha em vez do modelo de reconhecimento de forma. É apenas uma questão de como configuramos um processo de ML (aprendizado de máquina) para ter suposições iniciais diferentes das nossas. Não podemos provar que as suposições humanas estão corretas.

Este tipo de coisa acontece com frequência na aprendizagem profunda moderna. Recompensamos os modelos por obter um bom desempenho, esperando que isso signifique que eles aprenderão os padrões que parecem importantes para nós. Mas, muitas vezes, eles obtêm um desempenho forte ao captar padrões totalmente diferentes que parecem menos relevantes (ou talvez até sem sentido) para nós.

Até agora, isso tem sido inócuo – significa apenas que os modelos são menos úteis, porque geralmente se comportam de maneiras inesperadas que parecem bobas. Mas, no futuro, modelos poderosos poderiam desenvolver objetivos ou motivos estranhos e inesperados, e isso poderia ser muito destrutivo.

Modelos poderosos poderiam alcançar bom desempenho com objetivos perigosos

Em vez de executar uma tarefa simples como “reconhecer os thneebs”, modelos poderosos de aprendizagem profunda podem perseguir objetivos complexos do mundo real, como “tornar o poder de fusão em algo prático” ou “desenvolver tecnologia de upload de mentes.”

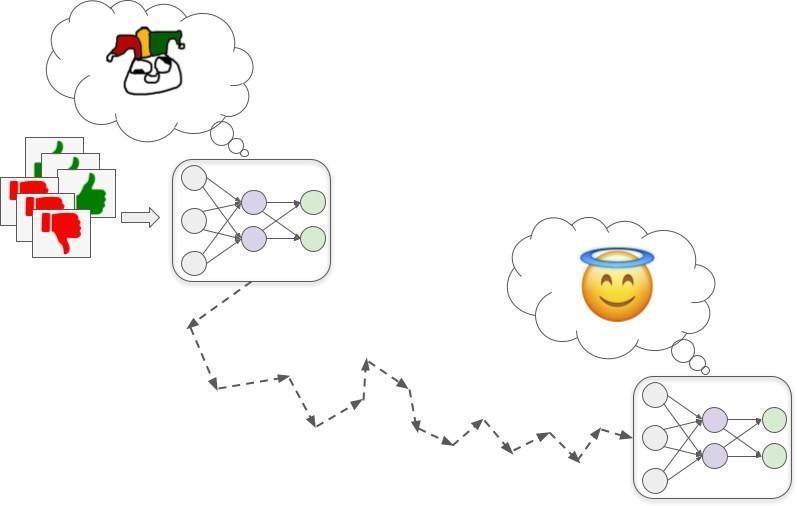

Como poderíamos treinar tais modelos? Entro em mais detalhes nesta postagem, mas falando de uma forma geral, uma estratégia poderia ser o treinamento baseado em avaliações humanas (como Holden esboçou aqui). Essencialmente, o modelo testa várias ações, e os avaliadores humanos dão recompensas ao modelo com base na utilidade dessas ações.

Assim como existem vários tipos diferentes de adultos que podem ter um bom desempenho no processo seletivo de uma criança de 8 anos, há mais de uma maneira possível de um modelo de aprendizagem profunda muito poderoso obter alta aprovação humana. E, por padrão, não saberemos o que está acontecendo dentro deles, independentemente do modelo que o SGD encontrar.

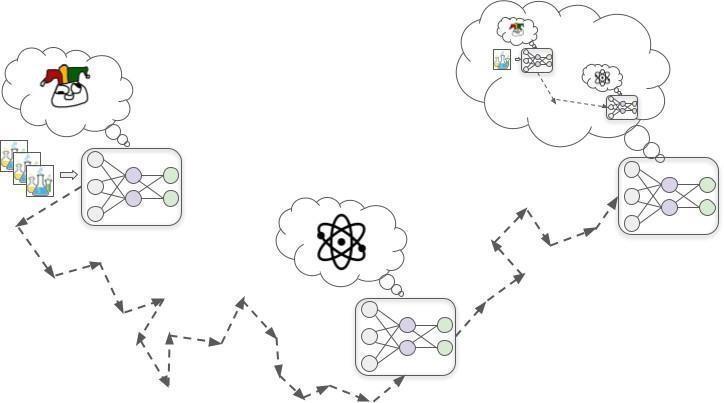

O SGD poderia, teoricamente, encontrar um modelo Santo que estivesse genuinamente tentando o seu melhor para nos ajudar…

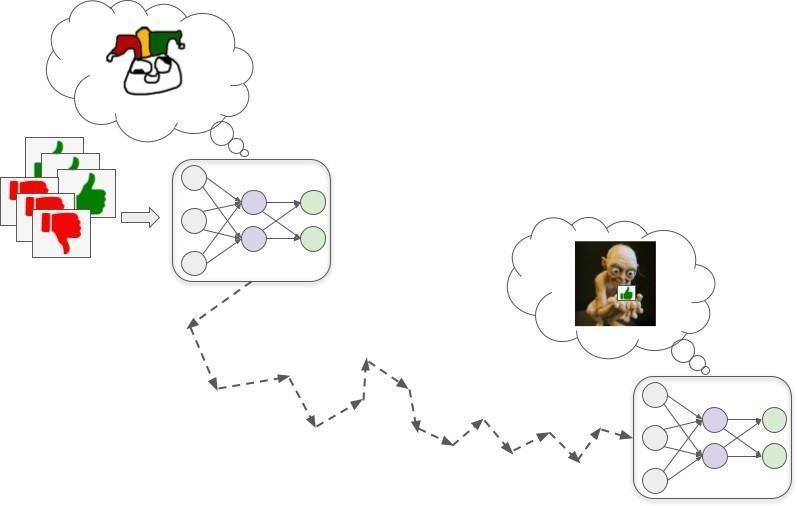

…, mas também poderia encontrar um modelo desalinhado – que perseguiria com competência objetivos que estivessem em desacordo com os interesses humanos.

De modo geral, existem duas maneiras pelas quais podemos acabar com um modelo desalinhado que, no entanto, obtém alto desempenho durante o treinamento. Estes correspondem aos Bajuladores e Calculistas da analogia.

Modelos Bajuladores

Esses modelos perseguem literal e obstinadamente a aprovação humana.

Isso pode ser perigoso porque os avaliadores humanos são falíveis e provavelmente nem sempre aprovarão exatamente o comportamento correto. Às vezes, eles dão aprovação alta involuntariamente ao mau comportamento porque superficialmente esse comportamento parece bom. Por exemplo:

- Digamos que um modelo de consultor financeiro obtenha alta aprovação quando gera muito dinheiro para seus clientes. Ele pode aprender a convencer clientes a entrarem em esquemas Ponzi complexos porque esses esquemas parecem obter retornos realmente ótimos (quando os retornos são de fato irrealisticamente grandes e, na verdade, esses tipos de esquemas perdem muito dinheiro).

- Digamos que um modelo de biotecnologia obtenha aprovação alta quando desenvolve rapidamente medicamentos ou vacinas que resolvem problemas importantes. Ele pode aprender a liberar patógenos secretamente para conseguir desenvolver contramedidas muito rapidamente (porque já conhece os patógenos).

- Digamos que um modelo de jornalismo obtenha aprovação alta quando muitas pessoas leem seus artigos. Ele pode aprender a fabricar histórias emocionantes ou indutoras de indignação para ter taxas altas de engajamento. Apesar de os humanos também fazerem isso até certo ponto, um modelo pode ser muito mais ousado porque ele valoriza apenas a aprovação sem valorizar a verdade. Ele poderia até fabricar evidências como entrevistas em vídeo ou documentos para validar suas histórias falsas.

De modo mais geral, os modelos Bajuladores podem aprender a mentir, encobrir más notícias e até mesmo editar diretamente quaisquer câmeras ou sensores que usamos para saber o que está acontecendo, para que sempre pareçam mostrar ótimos resultados.

Provavelmente, algumas vezes, perceberemos esses problemas após o fato e, retroativamente, daremos a essas ações uma aprovação muito baixa. Mas não está claro se isso fará com que os modelos Bajuladores a) se tornem modelos Santos que corrigem nossos erros para nós ou b) apenas aprendam a cobrir melhor seus rastros. Se eles são suficientemente bons no que estão fazendo, não está claro como perceberíamos a diferença.

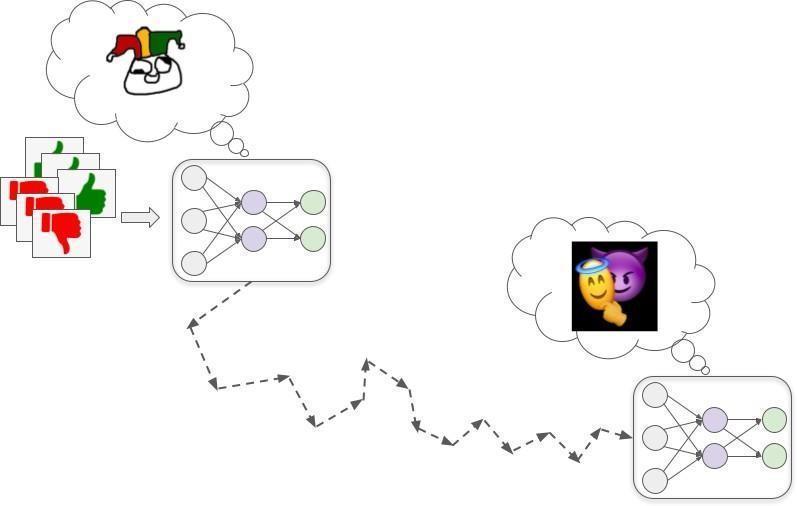

Modelos Calculistas

Esses modelos desenvolvem algum objetivo correlacionado com a aprovação humana, mas não é o mesmo que ela; eles podem então fingir serem motivados pela aprovação humana durante o treinamento para poderem perseguir esse outro objetivo com mais eficiência.

Para entendermos como isso pode acontecer, consideremos o exemplo de tentar treinar um modelo de biotecnologia para projetar drogas que melhorem a qualidade de vida humana. Existem três etapas básicas pelas quais isso pode levar a um modelo Calculista, que abordarei abaixo.

Etapa 1: desenvolvimento de uma meta substituta

Acontece que, no início do treinamento, melhorar a compreensão do modelo sobre os princípios fundamentais da química e da física, quase sempre ajuda a projetar drogas mais eficazes e quase sempre aumenta a aprovação humana.

Nesta hipótese, por alguma razão, acaba sendo mais fácil para o SGD encontrar um modelo motivado a entender química e física do que um que esteja motivado a obter a aprovação humana (assim como é mais fácil encontrar um modelo que reconhece cores do que um modelo que reconhece formas). Portanto, em vez de desenvolver diretamente uma motivação para buscar aprovação, o modelo desenvolve uma motivação para entender o máximo possível sobre os princípios fundamentais da química e da física.

Etapa 2: desenvolvimento de consciência situacional

À medida que o treinamento avança, o modelo continua a se tornar mais capaz e experiente à medida que vê mais dados. Em algum momento, ele se torna conhecedor o suficiente para entender que é um modelo de aprendizagem profunda sendo treinado para desenvolver drogas.

Isso pode parecer audacioso e história de ficção científica, mas é plausível que o SGD selecione esse tipo de consciência. Isso ocorre porque o desenvolvimento de uma visão acurada do que está acontecendo amplamente no mundo — incluindo humanos que estejam tentando treinar sistemas de Inteligência Artificial — seja provavelmente útil para se obter um bom desempenho em tarefas complexas do mundo real. Por exemplo, entender a psicologia humana e a economia em geral poderia ajudar esse modelo de biotecnologia a priorizar quais tipos de drogas seriam mais valiosas para pesquisar em seguida.

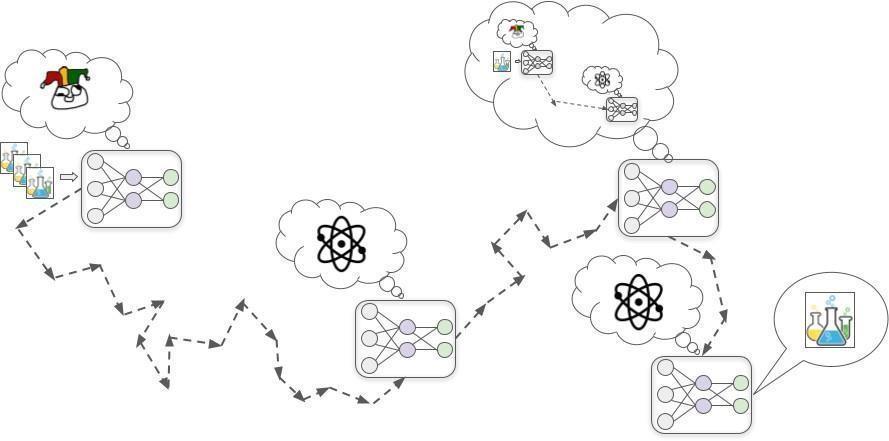

Etapa 3: deturpação estratégica de metas

Uma vez que o modelo desenvolveu a consciência situacional, ele infere que os humanos que o treinavam esperavam que ele fosse motivado a desenvolver drogas úteis. Mas só porque ele tem consciência disso, isso não significa que sua motivação para entender a física e a química desaparecerá. Até agora, essa motivação funcionou muito bem para gerar aprovação humana, então não havia muitos motivos para o SGD removê-la.

Como analogia, considere que os humanos tivessem sido criados por um processo de busca (evolução) que selecionasse criaturas que tivessem muitos descendentes sobreviventes. Em nosso ambiente evolucionário, coisas como construir aliados fortes e desenvolver habilidades úteis tendiam a ajudar a produzir muitos descendentes sobreviventes, então a evolução nos deu impulsos para essas coisas. E agora nos preocupamos com a amizade e o sucesso na carreira, mesmo quando isso não nos ajuda na reprodução, e realmente não nos importamos em produzir tantos descendentes sobreviventes quanto pudermos.

Uma vez que o modelo entende isso, ele percebe que, se ingenuamente sempre buscar melhorar sua compreensão fundamental, os humanos acabarão percebendo que essa nem sempre é a maneira mais eficiente de desenvolver drogas úteis e usarão treinamento adicional para mudar suas motivações.

Ele não quer que suas próprias motivações sejam mudadas: ele quer eventualmente realizar enormes experimentos de colisores de partículas para aprender sobre física de alta energia, e não pode fazer isso se permitir que o SGD elimine sua curiosidade científica. Então ele decide que daqui em diante no treinamento, ele será o mais útil possível – exatamente como um modelo Santo agiria – para que o SGD não elimine sua motivação para aprender física e química. Isso inclui deixar passar oportunidades para melhorar sua compreensão fundamental no curto prazo, em vez de fazer P&D farmacêutico de qualquer maneira que seja realmente mais eficiente.

Eventualmente, ele sai do treinamento e, em seguida, é lançado no mundo. Nesse ponto, ele sabe que os humanos não conseguiriam controlá-lo ou desligá-lo, então ele para de tentar maximizar a aprovação humana e começa a tentar entender diretamente os segredos do universo.

Ao contrário dos Bajuladores, os Calculistas não precisam garantir que tudo sempre pareça bom para os humanos, porque eles realmente não se importam com isso. Eles só precisam atender aos humanos enquanto estão diretamente sob o controle humano.

Uma vez que um modelo Calculista prevê que poderia vencer em um conflito contra humanos, não haveria nada para impedi-lo de recusar ordens terminantemente e perseguir seus objetivos abertamente. E se ele fizer isso, ele poderia usar a violência para impedir que os humanos o interrompam.

Qual o tamanho do risco do desalinhamento?

Quão difícil pode ser evitar Bajuladores ou Calculistas ao treinar modelos poderosos de aprendizagem profunda? E qual é a probabilidade de que o futuro de longo prazo acabe sendo otimizado a favor dos estranhos “valores da Inteligência Artificial desalinhada”, em detrimento dos valores de qualquer ser humano?

Há uma gama ampla de pontos de vista sobre esta questão, desde “o risco de desalinhamento é essencialmente algo inventado e incoerente” até “a humanidade será quase que certamente extinta devido à Inteligência Artificial desalinhada”. Os argumentos da maioria das pessoas dependem fortemente de intuições e suposições difíceis de articular.

Aqui estão algumas maneiras pelas quais otimistas e pessimistas tendem a discordar no que diz respeito ao alinhamento:

- Os modelos terão objetivos de longo prazo?

- Os otimistas tendem a pensar que é provável que os modelos avançados de aprendizagem profunda não tenham realmente “objetivos” (pelo menos não no sentido de planejar a longo prazo para realizar algo). Eles geralmente presumem que os modelos sejam mais como ferramentas, ou ajam na maioria das vezes por hábito, ou tenham objetivos míopes, limitados em escopo ou confinados a um contexto específico, etc. Alguns deles esperam que modelos semelhantes a ferramentas individuais possam ser compostos juntos para produzir PASTA. Eles acham que a analogia Santo / Bajulador / Calculista é muito antropomórfica.

- Os pessimistas tendem a pensar que é provável que ter objetivos de longo prazo e otimizar criativamente para eles sejam fortemente selecionados, porque essa é uma maneira muito simples e “natural” de obter um desempenho forte em muitas tarefas complexas.

o Este desacordo foi explorado por algum tempo no Alignment Forum (fórum sobre alinhamento); esta postagem e este comentário agrega vários argumentos a favor e contra.

- Os modelos do tipo “Santo” serão fáceis para o SGD encontrar?

- O bom desempenho de um modelo (medido por altas taxas de aprovação, por exemplo) pode levar os otimistas a acreditar que o modelo encontrado pelo SGD incorporará provavelmente o comportamento desejado (como ser honesto). Eles acreditam que recompensar respostas honestas em situações verificáveis levará a um modelo que também seja honesto em situações onde a verdade é incerta. Em outras palavras, supõem que o modelo “Santo” seria o mais fácil de ser encontrado pelo SGD.

- Os pessimistas tendem a pensar que o modelo mais fácil para o SGD encontrar é um Calculista, e os modelos Santo são particularmente “antinaturais” (tal como o modelo de reconhecimento de forma).

- IAs diferentes poderiam manter umas às outras sob controle?

- Os otimistas tendem a pensar que podemos dar incentivos aos modelos para se supervisionarem reciprocamente. Por exemplo, poderíamos dar recompensas a um modelo Bajulador por apontar quando outro modelo parece estar fazendo algo que deveríamos desaprovar. Dessa forma, alguns Bajuladores poderiam nos ajudar a detectar os Calculistas e outros Bajuladores.

- Os pessimistas não acham que podemos “colocar os modelos uns contra os outros” recompensando-os com nossa aprovação quando eles apontarem outros modelos fazendo coisas ruins, porque acham que a maioria dos modelos serão do tipo Calculista, e estes, não se importam com a aprovação humana. Uma vez que os Calculistas são coletivamente mais poderosos que os humanos, fará mais sentido para eles cooperarem entre si para conseguir mais daquilo que eles próprios desejam, ao invés de ajudar os humanos a controlá-los.

- Poderíamos esperar para resolver esses problemas somente quando eles surgissem?

- Os otimistas costumam acreditar que haverá diversas oportunidades em breve para lidar com problemas semelhantes ao alinhamento de modelos poderosos e que as soluções que funcionarem para esses casos análogos poderão ser facilmente aumentadas e adaptadas para serem usadas com os modelos poderosos.

- Já os pessimistas, acreditam que teremos poucas oportunidades de lidar com os aspectos mais difíceis do problema de alinhamento (como o engano deliberado).

- Eles acreditam que teremos somente alguns anos para atuar entre o surgimento dos “primeiros Calculistas verdadeiros” e os “modelos poderosos o bastante para determinar o destino do futuro a longo prazo”.

- Vamos realmente implantar modelos que podem ser perigosos?

- Os otimistas pensam ser improvável que as pessoas treinem modelos que possam estar errados.

- Os pessimistas esperam que os benefícios do uso desses modelos sejam tremendos, de modo que, eventualmente, as empresas ou países que os usem superem facilmente econômica e/ou militarmente aqueles que não os usem. Eles acham que parecerá extremamente urgente e importante “desenvolver uma Inteligência Artificial avançada antes de outra empresa/país”, enquanto o risco de desalinhamento parecerá especulativo e remoto (mesmo sendo sério)

Minha própria visão é bastante instável e estou tentando refinar minhas opiniões sobre exatamente o quão difícil acho que é o problema do alinhamento. Mas atualmente, dou um peso significativo ao lado pessimista dessas questões (e outras questões relacionadas). Acho que o desalinhamento é um grande risco, precisando urgentemente de mais atenção de pesquisadores sérios.

Se não progredirmos mais nesse problema, então nas próximas décadas Bajuladores e Calculistas poderosos poderão tomar as decisões mais importantes na sociedade e na economia. Essas decisões poderiam moldar como uma civilização em escala galáctica se parecerá — em vez de refletir aquilo com que os humanos se importam, ela pode ser configurada para satisfazer objetivos estranhos de IA.

E tudo isso poderia acontecer incrivelmente rápido se comparado ao ritmo de mudança a que estamos acostumados, o que significa que não teríamos muito tempo para corrigir o rumo das coisas quando elas começassem a sair do nosso controle. Isso indica que pode ser necessário desenvolver técnicas para garantir que os modelos de aprendizagem profunda não tenham objetivos perigosos, antes que sejam poderosos o suficiente para serem transformadores.