Este artigo começa com um resumo de quando devemos esperar que a IA Transformadora seja desenvolvida, com base nas várias perspectivas abordadas anteriormente na série. Acho que este artigo é útil, mesmo que você já tenha lido todos os artigos anteriores, mas se quiser ignorá-lo, clique aqui.

Abordo a questão: “Por que não há consenso robusto de especialistas sobre este tópico e o que isto significa para nós?”

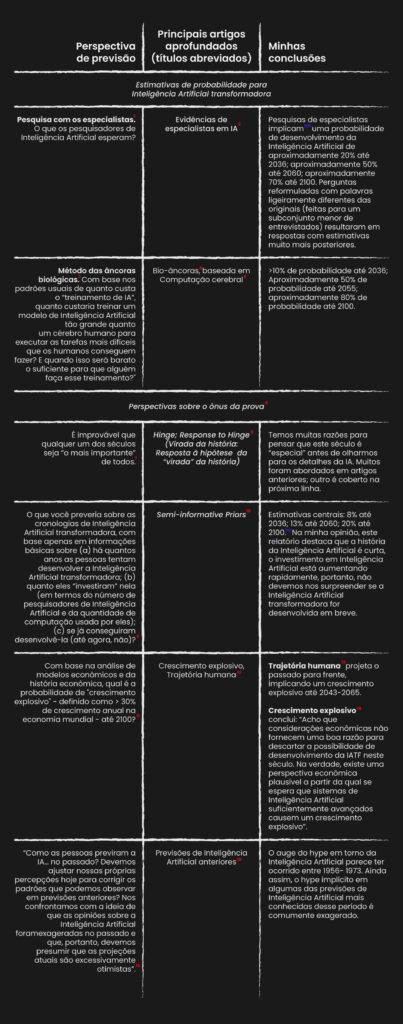

Estimo que há mais de 10% de probabilidade da Inteligência Artificial transformadora ser desenvolvida dentro de 15 anos (até 2036); aproximadamente 50% disso acontecer dentro de 40 anos (até 2060); e aproximadamente 2/3 de que ela seja desenvolvida ainda neste século (até 2100).

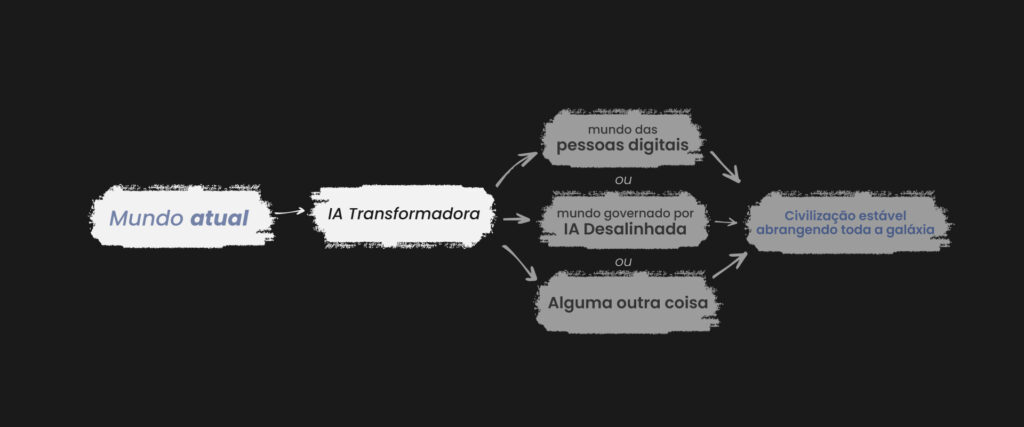

(Por “IA Transformadora”, quero dizer “IA poderosa o suficiente para nos levar a um futuro novo e qualitativamente diferente”. Argumentei que a Inteligência Artificial avançada poderia ser o suficiente para tornar este o século mais importante.)

Essa conclusão é baseada em relatórios técnicos que abordam a previsão de Inteligência Artificial de diferentes perspectivas – muitos desses relatórios foram produzidos pela Open Philanthropy nos últimos anos, para desenvolver um panorama completo da previsão da Inteligência Artificial transformadora para fomentar ações de longo prazo.

Aqui está um resumo de uma tabela das diferentes perspectivas de previsão da Inteligência Artificial transformadora discutidas anteriormente, com links para discussões mais detalhadas em postagens anteriores, bem como para relatórios técnicos subjacentes:

Tendo considerado o que foi dito acima, espero que alguns leitores ainda sintam uma sensação de desconforto. Mesmo que achem que meus argumentos fazem sentido, podem estar se perguntando: se isso é verdade, por que não é mais amplamente discutido e aceito? Qual é o estado da opinião de especialistas?

Meu resumo do estado da opinião de especialistas atualmente é:

- Minhas afirmações não contradizem nenhum consenso específico de especialistas. (Na verdade, as probabilidades que dei não estão muito longe do que os pesquisadores de Inteligência Artificial parecem prever, como mostrado na primeira linha.) Mas há alguns sinais de que eles não estão pensando muito sobre o assunto.

- Os relatórios técnicos da Open Philanthropy nos quais confiei tiveram uma revisão significativa feita por especialistas externos. Pesquisadores da área de Aprendizado de Máquina analisaram a Bio Anchors (Bio-âncoras); neurocientistas analisaram a Brain Computation (Computação cerebral); economistas analisaram a Explosive Growth (Crescimento explosivo); acadêmicos com foco em tópicos relevantes sobre incerteza e/ou probabilidade analisaram a Semi-informative Priors (Priori semi-informativa). (Algumas dessas análises tinham pontos significativos de desacordo, mas nenhum desses pontos parecia ser sobre casos em que os relatórios contradiziam um claro consenso de especialistas ou a literatura da área.)

- Mas também não há um consenso ativo e robusto de especialistas corroborando afirmações como “Há pelo menos 10% de probabilidade da Inteligência Artificial transformadora ser desenvolvida até 2036” ou “Há uma boa chance de estarmos no século mais importante para a humanidade”, da mesma maneira que existem argumentos que embasam a necessidade de agir contra as alterações climáticas, por exemplo.

Em última análise, minhas afirmações são sobre tópicos que simplesmente não têm uma “área do conhecimento” com especialistas dedicados a estudá-los. Isso, por si só, é um fato assustador e algo que espero que mude eventualmente.

Mas, enquanto isso, devemos estar dispostos a agir segundo a hipótese do “século mais importante”?

Abaixo, comentarei:

- Como seria um “campo de estudos de previsão da IA”.

- Uma “visão cética” que diz que as discussões atuais sobre esses tópicos são muito pequenas, homogêneas e insulares (o que eu concordo) — e que, portanto, não devemos agir sobre a hipótese do “século mais importante” até que haja um campo de estudos maduro e robusto (o que eu não concordo).

- Porque acredito que devemos levar a hipótese a sério enquanto isso, até e a menos que tal campo de estudos se desenvolva:

- Não temos tempo para aguardar por um consenso robusto de especialistas.

- Se houver boas refutações por aí — ou futuros especialistas em potencial que possam desenvolver tais refutações — ainda não os encontramos. Quanto mais a hipótese for levada a sério, maior a probabilidade de tais refutações aparecerem. (Também conhecida como a teoria da Lei de Cunningham: “a melhor maneira de obter uma resposta certa é postar uma resposta errada”.)

- Acho que insistir consistentemente na criação de um consenso robusto de especialistas é um padrão de raciocínio perigoso. Na minha opinião, não é um problema correr o risco de autoilusão e isolamento, em troca de se fazer a coisa certa quando isso é o mais importante.

Que tipo de especialização é a especialização em previsão de IA?

As questões analisadas nos relatórios técnicos listados acima incluem:

- As habilidades da Inteligência Artificial estão ficando cada dia mais surpreendentes com o tempo? (IA, história da IA)

- Como podemos comparar modelos de Inteligência Artificial com cérebros de animais/humanos? (IA, neurociência)

- Como podemos comparar as habilidades da Inteligência Artificial com as habilidades dos animais? (IA, etologia)

- Como podemos estimar o custo de treinar um sistema de Inteligência Artificial grande o suficiente para realizar uma tarefa difícil, com base nas informações que temos sobre treinamentos anteriores de sistemas de IA? (IA, ajuste de curva).

- Como podemos fazer uma estimativa com o mínimo de informações sobre Inteligência Artificial transformadora, com base apenas em quantos anos/pesquisadores/dólares foram investidos no campo de estudos até agora? (Filosofia, probabilidade).

- Qual é a probabilidade de um crescimento econômico explosivo neste século, com base na teoria e nas tendências históricas? (Economia do crescimento, história econômica)

- Como foi o “hype em torno da IA” no passado? (História)

Ao falar sobre implicações mais amplas da Inteligência Artificial transformadora para o “século mais importante”, também discuti temas como “Qual a viabilidade do desenvolvimento de pessoas digitais e o estabelecimento de assentamentos espaciais em toda a galáxia?” Esses tópicos abordam física, neurociência, engenharia, filosofia da mente e muito mais.

Não há trabalho ou credencial óbvia que torne alguém um especialista na questão de quando podemos esperar uma Inteligência Artificial transformadora, ou na questão de saber se estamos no século mais importante.

(Eu discordaria particularmente de qualquer afirmação de que deveríamos confiar exclusivamente em pesquisadores de Inteligência Artificial para essas previsões. Além da aparente falta de reflexão profunda sobre o assunto, acredito que confiar em especialistas em IA para prever o desenvolvimento da IA transformadora é semelhante a confiar em empresas de energia solar ou de petróleo para prever as emissões de carbono e as mudanças climáticas. Embora compreendam parte do cenário, a previsão é uma habilidade distinta da inovação ou da construção de sistemas de ponta. Eles certamente entendem parte do panorama. Mas a previsão é uma atividade distinta da inovação ou construção de sistemas de ponta.)

E nem tenho certeza se essas perguntas têm a forma certa para um campo acadêmico. Tentar prever a Inteligência Artificial transformadora ou determinar as chances de estarmos no século mais importante parece:

- Mais semelhante ao modelo eleitoral da Five Thirty Eight (“Quem vai ganhar a eleição?”) do que à ciência política acadêmica (“Como governos e constituintes interagem?”);

- Mais semelhante aos mercados financeiros (“Este preço vai subir ou descer no futuro?”) do que à economia acadêmica (“Por que existem recessões?”);111

- Mais parecido com a pesquisa da GiveWell (“Qual instituição de caridade ajudará mais as pessoas, por dólar?”) do que a economia do desenvolvimento (“O que causa a pobreza e o que pode reduzi-la?”)112

Ou seja, não está claro para mim como seria um “lar institucional” natural para especialização em previsão transformadora de Inteligência Artificial e o “século mais importante”. Mas parece justo dizer não haver instituições grandes e robustas dedicadas a esse tipo de questão hoje.

Como devemos agir na ausência de um consenso sólido de especialistas?

A visão cética

Na falta de um consenso robusto de especialistas, espero que algumas pessoas (na verdade, a maioria) sejam céticas, não importa quais argumentos sejam apresentados.

Aqui está uma versão de uma reação cética muito comum pela qual tenho bastante empatia:

- Isto é muito audacioso.

- Você está fazendo uma afirmação exagerada sobre viver no século mais importante. Este padrão corresponde à autoilusão.

- Você argumentou que o ônus da prova não deveria ser tão alto, porque existem muitas razões para acreditar que vivemos em uma época notável e instável . Mas… não confio em mim mesmo para avaliar essas afirmações, ou suas afirmações sobre IA, ou realmente qualquer coisa sobre esses tópicos audaciosos.

- Estou preocupado que tão poucas pessoas parecem estar engajadas nesses argumentos sobre como a discussão parece pequena, homogênea e insular. No geral, isso parece uma história que as pessoas inteligentes estão contando a si mesmas – com muitos gráficos e números para racionalizá-la – sobre seu próprio lugar na história. Não parece “real”.

- Então me ligue de volta quando houver um campo maduro de talvez centenas ou milhares de especialistas, se criticando e avaliando reciprocamente, e quando eles chegarem ao mesmo tipo de consenso que vemos para a mudança climática.

Entendo por que você se sente assim, e eu mesmo já me senti assim algumas vezes – especialmente nos pontos n.º 1 ao 4. Mas darei três razões pelas quais o ponto n.º 5 não está correto.

Motivo 1: não temos tempo para esperar por um consenso robusto de especialistas

Eu me preocupo de que a chegada da Inteligência Artificial transformadora possa se tornar uma espécie de versão em câmera lenta e de alto risco da pandemia da COVID-19. O argumento para esperar que algo grande aconteça existe, se você estudar as melhores informações e análises disponíveis atualmente. Mas a situação é amplamente desconhecida; não se encaixa nos padrões com os quais nossas instituições lidam regularmente. E cada ano extra de ação é valioso.

Você também pode pensar nisso como uma versão acelerada da dinâmica com a mudança climática. Imagine se as emissões de gases de efeito estufa só tivessem começado a aumentar recentemente113 (em vez de em meados dos anos 1800), e se não houvesse um campo estabelecido da ciência do clima. Seria uma péssima ideia esperar décadas pelo surgimento de um campo, antes de tentar reduzir as emissões.

Motivo 2: A Lei de Cunningham (“a melhor maneira de obter uma resposta certa é postar uma resposta errada”) pode ser nossa melhor esperança para encontrar a falha nesses argumentos

Estou falando sério.

Há vários anos, alguns colegas e eu suspeitávamos que a hipótese do “século mais importante” poderia ser verdadeira. Mas antes de agirmos, queríamos ver se poderíamos encontrar falhas fatais nessa hipótese.

Uma forma de interpretar nossas ações nos últimos anos é interpretá-las como se estivéssemos fazendo de tudo para comprovar que a hipótese está errada.

Primeiro, tentamos conversar com as pessoas sobre os argumentos principais —pesquisadores de IA, economistas, etc. Mas:

- Tínhamos ideias vagas sobre os argumentos desta série (principalmente, ou talvez totalmente, oriundos de outras pessoas). Não conseguíamos explicá-los de forma nítida e específica.

- Havia muitos argumentos concretos importantes que achávamos que provavelmente estariam corretos,114 mas eles não tinham sido definidos ainda e não estavam prontos para serem apresentados.

- No geral, não conseguimos articular um caso concreto o suficiente para dar aos outros uma oportunidade justa de refutá-lo.

Por isso, trabalhamos muito na criação de relatórios técnicos sobre muitos desses principais argumentos. (Eles agora são públicos e foram incluídos na tabela na parte superior deste artigo.) Isso nos deu a oportunidade de publicá-los e potencialmente encontrar contra-argumentos fatais.

Em seguida, contratamos análises de especialistas externos.115

Falando apenas por mim, a hipótese do “século mais importante” parece ter sobrevivido a tudo isso. Na verdade, após analisar muitas das perspectivas existentes e me aprofundar nos detalhes, acredito nessa hipótese com mais convicção do que antes.

Mas digamos que seja apenas porque os verdadeiros especialistas —pessoas que ainda não encontramos, com contra-argumentos devastadores — acham a coisa toda tão boba que nem se preocupam em discutir sobre isso. Ou, digamos, que existam pessoas por aí atualmente, que possam um dia se tornar especialistas nesses tópicos e derrubar esses argumentos. O que poderíamos fazer para isso acontecer?

A melhor resposta que encontrei para essa pergunta foi: “Se essa hipótese se tornasse mais conhecida, mais amplamente aceita e mais influente, ela seria analisada criticamente.”

Esta série é uma tentativa de dar um passo nessa direção —angariar uma credibilidade mais ampla para a hipótese do “século mais importante”. Isso seria uma coisa boa se a hipótese fosse verdadeira; também seria a próxima ação a ser tomada se o meu único objetivo fosse desafiar minhas crenças e descobrir que a hipótese é falsa.

Claro, não estou dizendo para você aceitar ou promover a hipótese do “século mais importante” se ela não parecer correta para você. Mas acredito que se a sua única desconfiança é a falta de um consenso robusto, continuar ignorando a situação me parece estranho. Se as pessoas se comportassem dessa maneira, em geral (ignorando qualquer hipótese que não fosse aceita por um consenso robusto de especialistas), não acredito que seria possível que qualquer hipótese — incluindo as verdadeiras — passasse de marginal a aceita.

Motivo 3: um ceticismo tão geral assim parece uma má ideia

Há um tempo, quando eu estava focado na GiveWell, as pessoas ocasionalmente me diziam coisas do tipo: “Sabe, você não pode exigir que todos os argumentos tenham o mesmo nível que as principais instituições de caridade da GiveWell — que sejam submetidos a ensaios clínicos randomizados, dados empíricos robustos, etc. Algumas das melhores oportunidades para fazer o bem serão as que são menos óbvias — portanto, este padrão de exigência pode eliminar algumas das suas maiores potenciais oportunidades de causar impacto.”

Eu concordo. Acho que é importante verificarmos qual é a abordagem geral de raciocínio e quais são os padrões probatórios e nos perguntar: “Em quais cenários a minha abordagem falha e em quais deles eu preferiria que ela não falhasse?

Na minha opinião, não há problema em correr o risco de autoilusão e isolamento, em troca de fazer a coisa certa quando isso é o mais importante.

Acho que a falta de um consenso robusto de especialistas — e preocupações com autoilusão e insularidade — nos dão boas razões para nos aprofundar na hipótese do “século mais importante” primeiro, antes de aceitá-la imediatamente. Perguntar-se onde pode haver uma falha oculta, se existe algum viés para inflar nossa própria importância, pesquisar as partes do argumento que parecem as mais questionáveis, etc.

Mas se você já investigou o assunto, o quanto for razoável ou prático para você e não encontrou nenhuma falha além de considerações do tipo “Não há um consenso robusto de especialistas” e “Estou preocupado com a autoilusão e o isolamento” — então acredito que descartar essa hipótese garantirá que você não será uma das primeiras pessoas a perceber e a agir em uma questão tremendamente importante, caso a oportunidade se apresente. Acredito ser muito sacrifício, no que diz respeito a renunciar a oportunidades com o potencial de fazer o bem.

Notas

109Tecnicamente, essas probabilidades são para “inteligência de máquina ao nível humano”. Em geral, este gráfico simplifica as coisas ao apresentar um conjunto unificado de probabilidades. Em geral, todas essas probabilidades referem-se a algo pelo menos tão capaz quanto o PASTA, então elas devem ser subestimadas direcionalmente da probabilidade de desenvolvimento do PASTA (embora eu não ache que isso seja um problema importante).

110Análises sobre o método das Bio-âncoras estão aqui; as análises sobre Crescimento Explosivo estão aqui; as análises sobre priori semi-informativas estão aqui. Computação cerebral foi analisado em um momento anterior, quando não tínhamos projetado o processo para resultar na publicação de análises, mas as mais de 20 conversas com especialistas que compuseram o relatório estão disponíveis aqui. A Trajetória Humana não foi revisada, embora muitas de suas análises e conclusões apareçam em Crescimento Explosivo, que foi analisado.

111Os campos acadêmicos são bastante amplos e estou apenas dando exemplos de questões que eles abordam.

112Embora a ciência do clima seja um exemplo de um campo acadêmico que investe muito em prever o futuro.

113O campo de estudos da Inteligência Artificial existe desde 1956, mas foi apenas na última década que os modelos de aprendizado de máquina começaram chegar próximos do tamanho dos cérebros de insetos e ter um bom desempenho em tarefas relativamente difíceis.

114Frequentemente, estávamos simplesmente partindo de nossas impressões sobre o que outras pessoas que já pensaram muito sobre o assunto haviam pensado.

115As análises sobre o método das Bio-âncoras estão aqui; as análises sobre Crescimento explosivo estão aqui; as análises sobre priori semi-informativa estão aqui. O Computação cerebral foi analisado em um momento anterior, quando não havíamos elaborado um processo para resultar na publicação de análises, mas mais de 20 conversas com especialistas que contribuíram com o relatório estão disponíveis aqui. O Trajetória Humana não foi revisado, embora muitas de suas análises e conclusões apareçam em Crescimento explosivo, analisado.